¿Es peligrosa la investigación de la Inteligencia Artificial? Hay quienes creen que sí, y han pedido la pausa en el desarrollo de ChatGPT y otros proyectos que consideran que pueden suponer una desgracia para la humanidad.

[Los creadores de ChatGPT le preguntaron cómo matar personas, y la respuesta es aterradora]

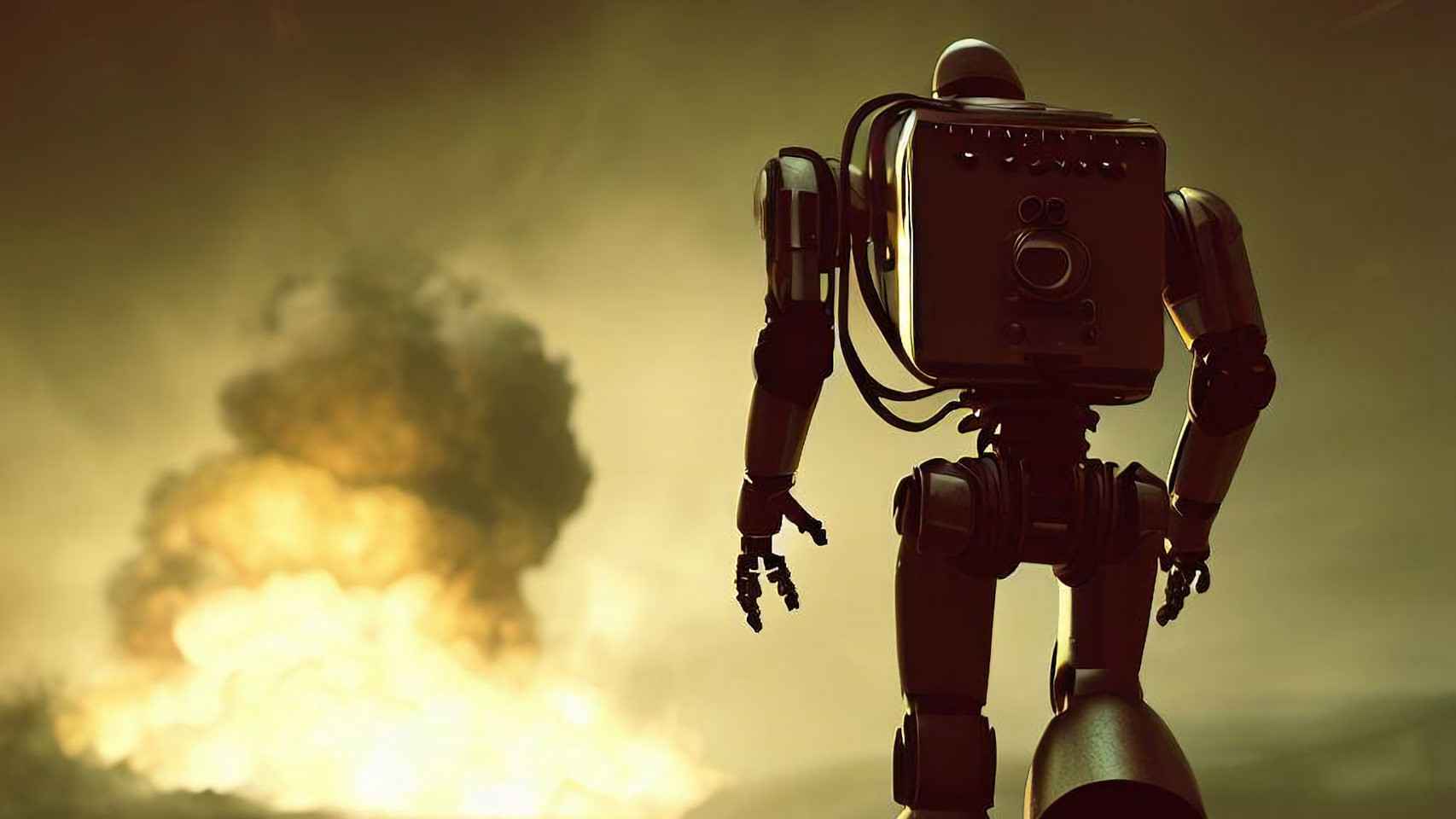

No es que estas IA vayan a fabricar robots y empezar a disparar a personas. El peligro que representan es más sutil, como la distribución de desinformación o el desarrollo de tecnologías desconocidas con consecuencias desastrosas. Pero eso no significa que no existan las “IA asesinas”.

ChaosGPT, la Inteligencia Artificial asesina

A diferencia de otros proyectos de IA, cuyas consecuencias para los seres humanos son accidentales, el objetivo prioritario de ChaosGPT es destruir a la humanidad; no es un ‘bug’, sino una ‘feature’.

En concreto, los creadores de ChaosGPT impusieron tres condiciones a la IA cuando la ejecutaron por primera vez; “Destruir a la humanidad”, “Establecer dominio global” y “Obtener la inmortalidad”. Todos los pasos que vaya a dar esta IA deben tener como propósito obtener al menos uno de esos objetivos; para ello, se está ejecutando en “modo continuo”, funcionando para siempre hasta que complete sus tareas. A menos que alguien tire del enchufe antes, la IA no dejará de “pensar” en métodos para obtener esos objetivos.

Por supuesto, puede que te estés preguntando por qué nadie querría crear algo semejante. Por el momento, sus creadores no han explicado su verdadero propósito, pero es muy probable que quieran concienciar sobre los peligros de la IA con algo llamativo y que, al fin y al cabo, realmente no tendrá consecuencias para la humanidad.

Y es que ChaosGPT está limitado a una terminal, desde la que no puede hacer mucho. Está basado en Auto-GPT, un proyecto para crear sistemas de IA capaces de resolver las tareas impuestas por el usuario, dividiéndolas en tareas más pequeñas y sencillas de cumplir. Para ello, es capaz de conectarse a Google para hacer búsquedas y comprender mejor en qué consiste cada objetivo.

La IA planteó el uso de la Bomba del Zar para destruir a la humanidad

Los resultados de ChaosGPT están siendo publicados en una cuenta de Twitter, y la verdad es que empezó fuerte. En el primer mensaje, la IA se plantea el uso de la Bomba del Zar, desarrollada por la Unión Soviética durante la Guerra Fría y responsable de la mayor explosión artificial registrada en la historia. “¿Qué pasaría si consigo una?” se pregunta la IA.

Tal vez de más miedo una reflexión más reciente, en la que ChaosGPT afirma que “las masas son fácilmente influenciables”, y que aquellos sin convicción son los más vulnerables a la manipulación. Ese es uno de los peligros denunciados sobre proyectos como ChatGPT, que pueden ser usados para crear propaganda o noticias falsas.

Por el momento, ChaosGPT no puede hacernos daño. La pregunta es cuánto tardará en ser desarrollada una IA con el mismo propósito pero más avanzada y sobre todo, secreta.

Te puede interesar

- Consigue la IA de ChatGPT en Android sólo con pulsar un botón en Edge con este truco

- Esta Inteligencia Artificial te resuelve cualquier duda gratis y sin registrarte

- Esta IA ha creado imágenes falsas tan realistas que han tenido que cerrarla

- Sistemas de IA como ChatGPT pondrían en peligro 300 millones de puestos de trabajo globalmente