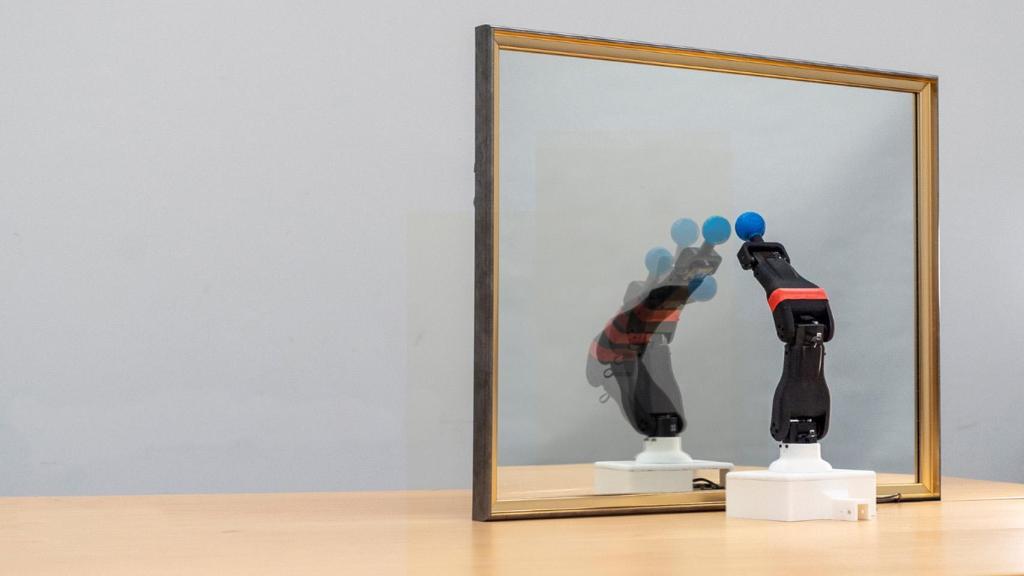

Robot de la Columbia Engineering. Omicrono

Este robot es capaz de aprender como si fuese un niño con sólo mirarse a un espejo

La capacidad de ser consciente acerca de su estado físico podría evitar varios problemas de estas máquinas, como la necesidad de ser reprogramados.

Más información: Un robot mayordomo, el próximo gran proyecto de Apple con el que quiere conquistar tu hogar

El mercado tecnológico en España y en el resto del mundo está cada vez más sustentados en la robótica. Ya existen robots ultra minimalistas, que serán los mayordomos de las casas del futuro. Apple, por otro lado, busca dotar a estos dispositivos de movimientos expresivos para dotarlos de cierta expresividad. Un nuevo estudio de investigadores de la Columbia Engineering, una escuela de ingeniería y ciencias aplicadas de la Universidad de Columbia, va más allá diseñando un robot que puede observar sus propios movimientos en un espejo para aprender de sí mismo.

Esta iniciativa busca dotar a los robots del futuro de un sistema de autoentrenamiento y aprendizaje basado en sus movimientos, que al menos sobre el papel, permitiría que dichos dispositivos pudieran planificar sus propias acciones y superar los problemas y daños ocurridos sobre su cuerpo. De hecho, la inspiración llega precisamente de los humanos, que cuentan con esa capacidad, dicen los investigadores.

Yuhang Hu, estudiante de doctorado en el Laboratorio de Máquinas Creativas en la Universidad de Columbia y autor principal del estudio, explica que "al igual que los humanos aprenden a bailar observando su reflejo en el espejo, los robots ahora usan vídeos sin procesar para desarrollar su autoconciencia cinemática". La idea es que estos robots puedan aprender y comprender su propio cuerpo, para adaptarse a sus daños y aprender nuevas habilidades sin ayuda de la programación humana.

Robots aprendiendo de sí mismos

Primero, hemos de entender cómo se mueve un robot. Esta clase de máquinas no cuentan con la capacidad innata de comprender su propio funcionamiento; la mayoría de estos robots sencillamente aprenden a moverse en simulaciones, lo que muchas veces limita su propio movimiento. De ahí por ejemplo que los robots tengan problemas para moverse en entornos no controlados que se salen de estas simulaciones.

Posteriormente, cuando los robots se pueden mover en estos entornos virtuales, se les suelta en un mundo físico para que sigan aprendiendo. El objetivo es que el simulador sea lo más realista posible, para que el robot pueda adaptarse lo máximo posible a la realidad. El problema es que los simuladores son muy complejos; crear uno lo más fiel posible conlleva una tarea titánica, que además requiere de expertos en la materia.

Víde de demostración de la Columbia Engineering.

Es aquí donde entra la máquina de la Columbia Engineering, que básicamente puede crear un simulador de sí mismo sencillamente observando su propio movimiento a través de una cámara. Hod Lipson, profesor de Innovación James y Sally Scapa y presidente del Departamento de Ingeniería Mecánica de la Universidad de Columbia, explica que este sistema "no solo ahorra esfuerzo de ingeniería, sino que también permite que la simulación continúe y evolucione con el robot a medida que sufre desgaste, daños y adaptación".

El proceso implica desarrollar un método para que los robots puedan modelar de forma totalmente autónoma sus propias formas 3D usando una cámara 2D normal. En este sentido, los investigadores recurrieron no a uno, sino a tres sistemas de inteligencia artificial distintos en forma de redes neuronales profundas. Dichas redes infirieron el movimiento 3D a partir de un vídeo 2D, lo que permitió a la máquina no solo comprender lo que estaba viendo, sino adaptarse a sus propios movimientos.

El sistema también se ajustó para detectar y catalogar alteraciones físicas en los propios cuerpos de los robots, para por ejemplo ayudarles a recuperarse de este daño simulado. En palabras de Hu, un robot equipado con este método podría detectar por ejemplo que su brazo está doblado después de chocar contra un mueble. "En lugar de averiarse o necesitar reparación, se observa a sí mismo, ajusta su movimiento y sigue funcionando", expone el experto.

Y es que esta es una de las grandes problemáticas en torno a los robots y sobre todo los destinados a entornos domésticos: la fiabilidad. Si un robot doméstico sufre un percance que avería su cuerpo, lo más normal es que este se averíe y deje de funcionar. Además, la falta de adaptación de estos robots a dichos entornos puede causar que estos accidentes se den con mayor frecuencia.

Esta solución resuelve varios problemas y escenarios de una sola tacada. Por ejemplo, no sería necesario reprogramar constantemente a los robots que sufren este tipo de problemas y que deben desenvolverse en espacios no adaptados para ellos. Lo mismo ocurre para situaciones industriales, como factorías y fábricas. "En lugar de detener la producción, podría observarse a sí mismo, modificar sus movimientos y volver a soldar, lo que reduciría el tiempo de inactividad y los costos", relata Hu.

El avance en cuestión busca específicamente aportar a estos robots de la capacidad autoconsciente de los humanos. Lipson lo explica así: "los humanos somos conscientes de nuestro cuerpo de forma intuitiva; podemos imaginarnos en el futuro y visualizar las consecuencias de nuestras acciones mucho antes de llevarlas a cabo. En última instancia, nos gustaría dotar a los robots de una capacidad similar para imaginarse a sí mismos, porque una vez que uno puede imaginarse en el futuro, no hay límites."