Apple ha decidido ir más allá en su lucha contra la pornografía infantil. La compañía ha creado un nuevo sistema de escaneo y cifrado con el que rastreará las fotos de sus usuarios en busca de contenido sospechoso. La nueva función basada en el aprendizaje automático no llegará por el momento a España, se pondrá primero a prueba en Estados Unidos, pero ya ha despertado recelo entre los expertos en ciberseguridad.

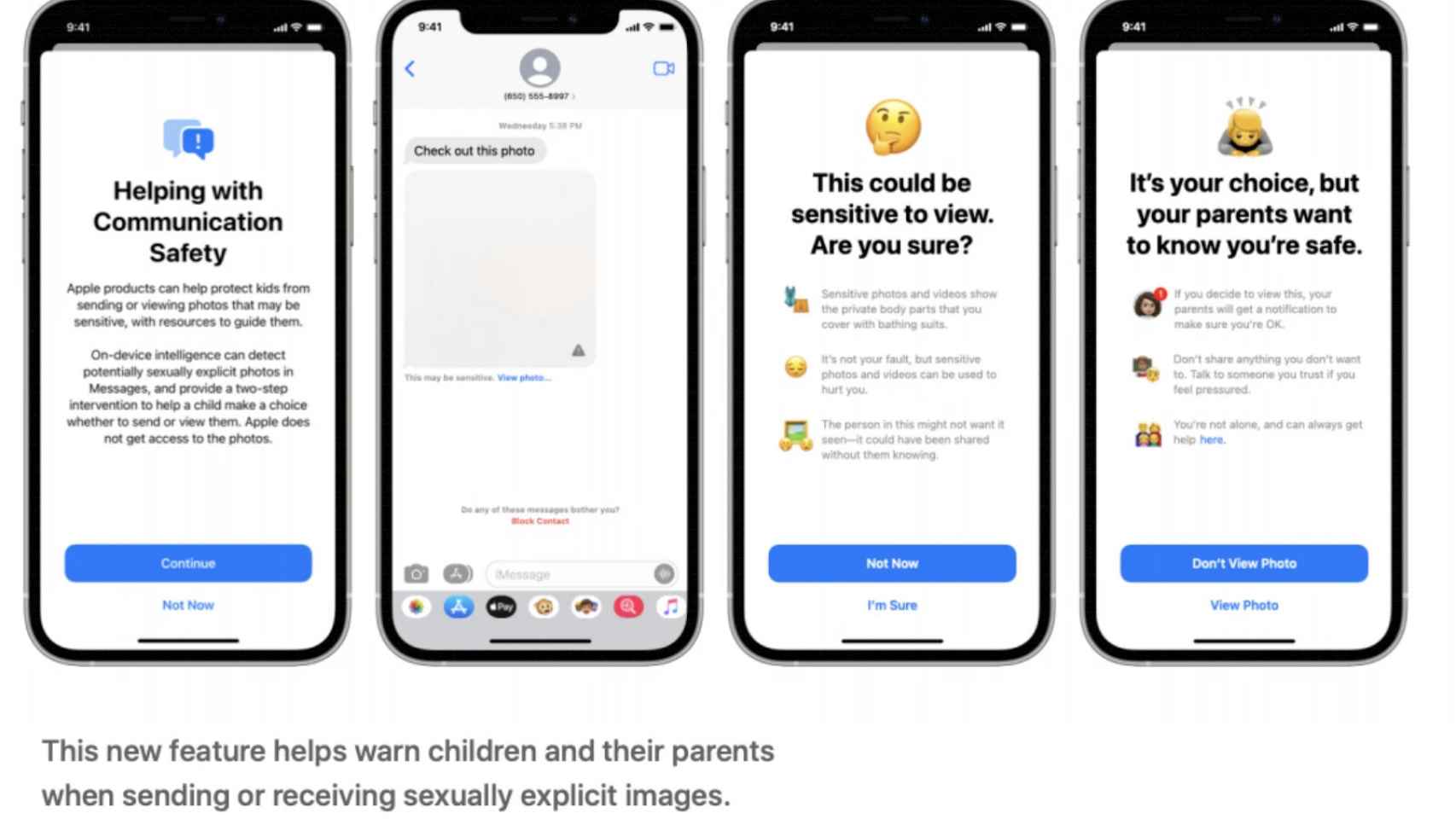

La compañía confirmaba así la información que adelantó en Twitter Mathew Green, profesor de criptografía en la Universidad Johns Hopkins, este jueves. A partir de ahora, los usuarios de iPhone recibirán una alerta si alguna de las imágenes que intentan mandar por iMessage es sospechosa de infundir abusos sexuales a menores.

"Messages utiliza el aprendizaje automático en el dispositivo para analizar los archivos adjuntos de imágenes y determinar si una foto es sexualmente explícita. La función está diseñada para que Apple no tenga acceso a los mensajes" detalla Apple en un informe donde se indica el funcionamiento de este sistema, que no es tan nuevo como parece.

¿Cómo funciona?

La tecnología se utilizará en iOS, macOS, WatchOS e iMessages desde donde se analizarán todas las imágenes que los usuarios pretendan compartir. Para ello han recurrido a algoritmos de aprendizaje automático conocidos como NeuralHash.

La tecnología hash analiza la imagen sin necesidad de visualizarla o abrir el archivo. Convierte cada fotografía en un número único que describe su contenido, como una huella dactilar digital, pero que para cualquier usuarios sería imposible comprender.

Apple tecnología hash

Después comparar ese código con los establecidos por la compañía como contenido sospechosos, si se detectan suficientes coincidencias entre un código y otro, se crea una alerta que difumina la imagen y bloquea que se pueda compartir.

Apple asegura que los padres podrán recibir avisos si sus hijos quieren mandar contenido catalogado como sospechoso. También podría alertarse a las autoridades de estas coincidencias para que un equipo humano revisará las imágenes.

Mathew Green explica en su cuenta de Twitter que esta tecnología puede dar falsos positivos al no ser muy precisas: "Esto es a propósito. Están diseñados para encontrar imágenes que se parecen a las malas imágenes, incluso si se han redimensionado, comprimido, etc." La compañía niega esta afirmación: "El riesgo de que el sistema marque incorrectamente una cuenta es extremadamente bajo. Además, Apple revisa manualmente todos los informes realizados al NCMEC para garantizar la precisión de los informes."

Los riesgos en privacidad

Lo que podría ser una herramienta clave para perseguir a delincuentes, pedófilos y terroristas, supone al mismo tiempo una amenaza para la privacidad de ciudadanos inocentes y un arma de gran utilidad para regímenes totalitarios, según denuncia el experto en ciberseguridad.

El problema de esta nueva herramienta estaría más bien en dónde van a buscar esas semejanzas. Las fotos almacenadas en los dispositivos y guardadas en iCloud se almacenan encriptadas en los servidores de Apple, pero como explican los expertos, las claves para descifrar esos códigos son propiedad de Apple.

Las únicas que cuentan con un encriptado de punto a punto (E2E) son las de iMessages que al igual que WhatsApp, van protegidas de un dispositivo a otro para que nadie, salvo los usuarios, puedan verlas. Aquí es donde, en teoría, entraría el nuevo sistema de Apple.

En realidad, este análisis del contenido no es tan nuevo. Facebook escanea publicaciones en busca de desnudos en sus redes sociales (Facebook e Instagram). También Apple ha utilizado sistemas hash para buscar imágenes de abuso infantil enviadas por correo electrónico, sistemas similares al de Gmail y otros proveedores de correo electrónico en la nube, que no están protegidos por el cifrado de extremo a extremo.

Green opina que esta tecnología manda un mensaje preocupante. "Independientemente de los planes de Apple a largo plazo, han enviado una señal muy clara. (...) es seguro construir sistemas que escaneen los teléfonos de los usuarios en busca de contenido prohibido", explica en su perfil de Twitter.

No obstante, no todos los expertos en ciberseguridad se han mostrado tan críticos. Nicholas Weaver, investigador principal del Instituto Internacional de Ciencias de la Computación en UC Berkeley, ha asegurado a Motherboard que la nueva función de Mensajes de Apple "parece una MUY buena idea". "En general, el enfoque de Apple parece bien pensado para ser eficaz y maximizar la privacidad", añade.

También te puede interesar...

- Google no actualiza sus apps de iPhone desde que Apple mejoró la privacidad de iOS

- La biblia de la privacidad y seguridad de Apple: el documento que revela cómo blinda tus datos

- Apple obligará a las apps a pedir permiso al usuario para rastrearle a partir de primavera