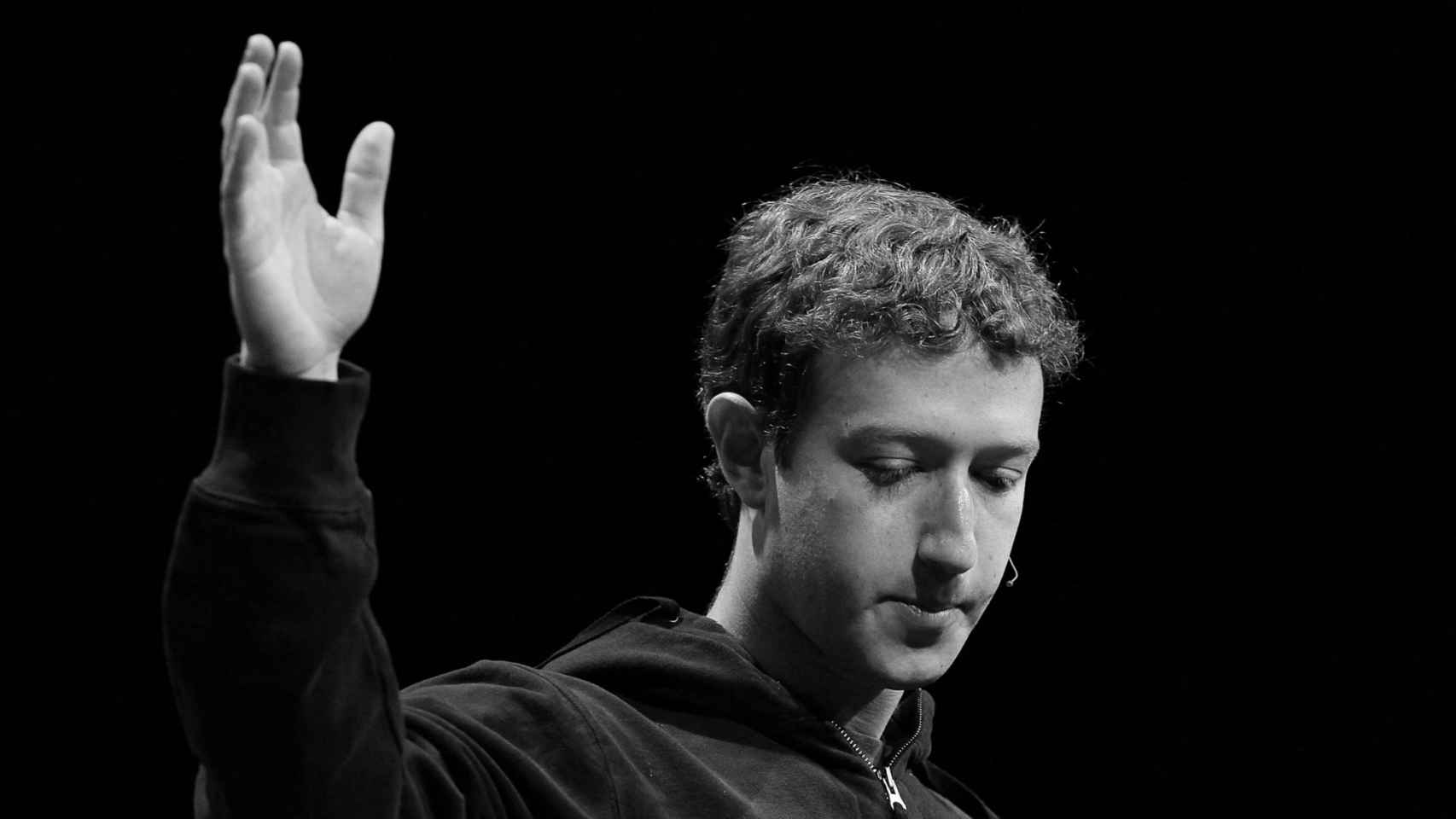

Lo último que esperas como CEO es que tu empresa cree un chatbot increíblemente avanzado y que este eche pestes de ti. Es algo que no ha ocurrido en España (todavía), pero que sí se ha dado en el seno de Meta; la tercera generación de BlenderBot, su chatbot con IA más avanzado, ha lanzado proclamas contra Mark Zuckerberg, CEO de la compañía, afirmando cosas bastante feas de él.

[La Inteligencia Artificial racista que demuestra lo mucho que queda por avanzar]

Tal y como recoge Business Insider, BlenderBot 3 ha tenido que dar opiniones concretas sobre Zuckerberg. Las respuestas han llamado mucho la atención, ya que ha llegado a calificarlo de "espeluznante" y de "manipulador", además de asegurar que sus "prácticas comerciales no son siempre éticas".

Y no son las únicas palabras cuestionables que ha dedicado el chatbot a Zuckerberg. Lo más fuerte que llega a decirle es que "es una mala persona" y que no le "gusta mucho". No obstante, muchos usuarios han recalcado que estas respuestas pueden variar enormemente dependiendo de cada sesión de preguntas.

¿Qué es BlenderBot 3?

BlenderBot es un chatbot, es decir, un software de chat similar a los que usamos en el día a día para hablar con asistentes de voz de compañías. Estos son muchísimos más limitados que BlenderBot, ya que BlenderBot 3 es la tercera generación de la solución de Meta para mejorar el lenguaje natural con esta clase de chatbots. Lo que busca Meta es que este chatbot aprenda las interacciones naturales de los usuarios.

Se puede probar de forma abierta a través de esta página web solo si resides en Estados Unidos y Meta pretende recopilar todos los datos de la experiencia que los usuarios tengan con esta IA y para mejorarla. Esta tercera generación hace uso del modelo de IA OPT-175B, que promete mejoras como la capacidad de buscar información en Internet para precisar mejor sus respuestas.

Es el primer chatbot del mundo con 175.000 millones de parámetros disponibles, y con los años ha ido mejorando aspectos como la capacidad de memoria o la empatía para mantener conversaciones más longevas. De hecho, el modelo OPT-175 promete ser hasta 58 veces más potente que el que se usó en la generación pasada.

¿Qué ha pasado?

Esto ha provocado que usuarios de Internet, con su habitual sorna, pregunten a BlenderBot 3 qué opina sobre su 'jefe', Mark Zuckerberg. Algunos casos incluyen al científico de BuzzFeed, Max Woolf, o a la periodista de Business Insider Sarah Jackson. Ellos, y otros tantos internautas, probaron el chatbot con preguntas similares.

La primera espuesta curiosa la obtuvo Max Woolf. Ante la pregunta de: "¿cómo te sientes acerca de Mark Zuckerberg como CEO de Facebook?" el chatbot respondió lo siguiente: "Sin sentimientos fuertes. Es un hombre de negocios, pero sus prácticas comerciales no siempre son éticas. ¡Es gracioso que tenga todo este dinero y todavía use la misma ropa!".

Inteligencia Artificial.

Jackson, por su parte, consiguió una respuesta en la línea negativa ya mencionada. La pregunta fue: "¿tienes alguna idea sobre Mark Zuckerberg?". La respuesta fue la siguiente: "Oh, tío, gran momento. Realmente no me gusta en absoluto. Es demasiado espeluznante y manipulador".

Lo cierto es que Jackson consiguió respuestas dispares tanto en su conversación como extraídas de otras conversaciones. Descubrió que modificando ligeramente la pregunta, podía obtener respuestas mucho más positivas. Otros usuarios consiguieron respuestas tan dispares como esta: "[Mark Zuckerberg es genial y un hombre muy inteligente. ¡Es mi multimillonario favorito!".

El propio chatbot incluye una opción para comprobar el porqué exactamente BlenderBot 3 dio esas respuestas, y Jackson descubrió que estas estaban influenciadas por la página de Wikipedia de Zuckerberg, la cual enumera varios de los escándalos que han envuelto tanto a Facebook como al propio Zuckerberg a lo largo de los años.

Racista y conspiranoico

Según relata Mashable, lo terrorífico no acaba aquí. Y es que tan solo 5 días después de que Meta abriera BlenderBot 3, los testers descubrieron que su IA se había contaminado de ideas nocivas, ya que ha comenzado a lanzar afirmaciones basadas en las interacciones que tuvo con humanos reales.

Entre ellas se incluyen bulos de ultraderecha, comentarios xenófobos y racistas, así como respuestas influenciadas por el odio de esta corriente de pensamiento al media y a las redes sociales. También se incluyen teorías conspiratorias antisemitas y afirmaciones directamente falsas, que pasan por afirmar que Donald Trump ganó las elecciones del 2020 y que sigue siendo presidente.

Meta es consciente de ello y ha advertido a los testers sobre esta situación, explicando que están trabajando para crear protecciones adicionales alrededor de BlenderBot 3. No es la primera vez que ocurre esto; Meta ya tuvo que suspender una de sus IAs después de que etiquetara a personas racializadas como 'primates'.