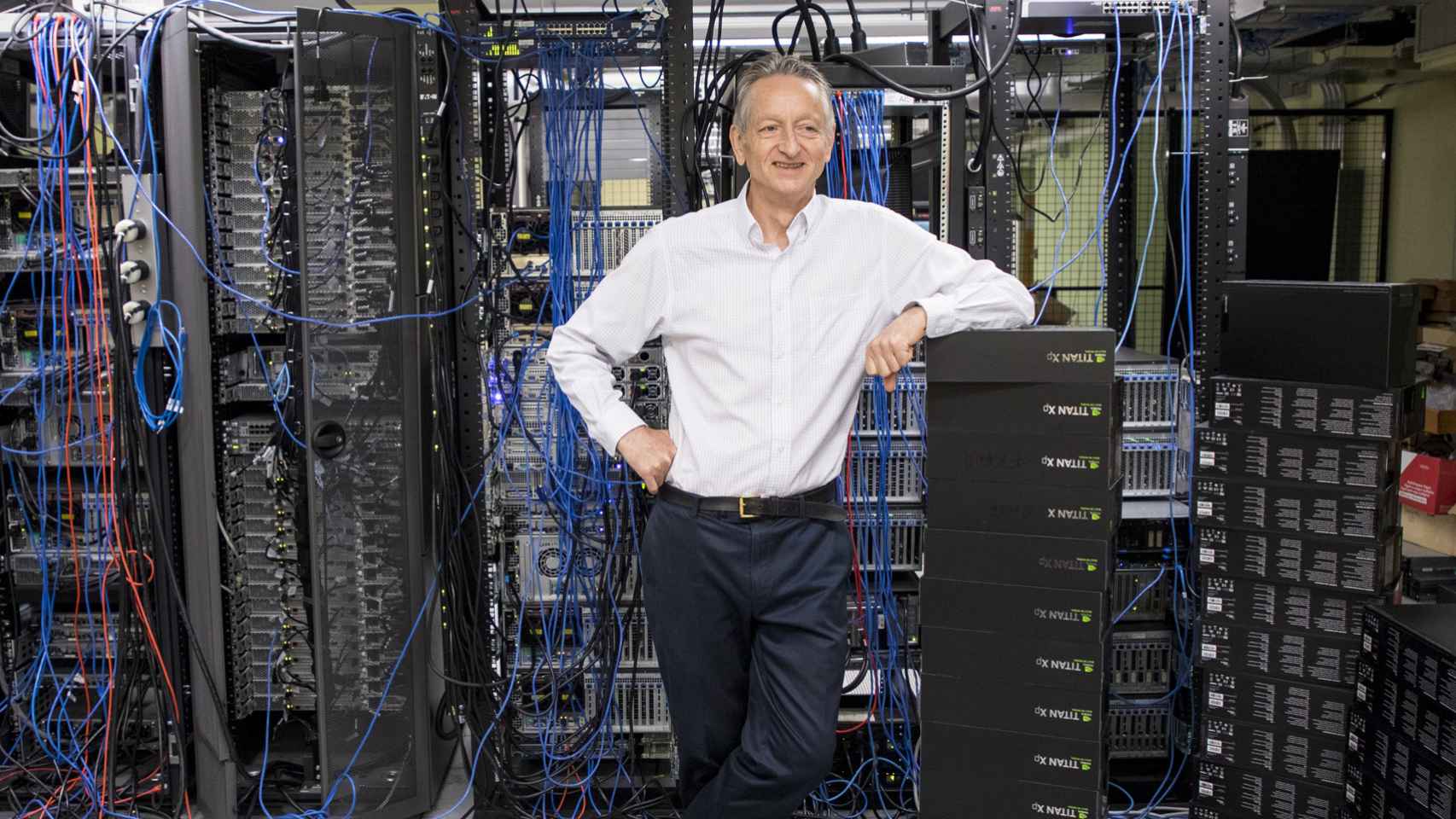

Si estás metido dentro del mundillo de la inteligencia artificial, quizás hayas oído hablar de Geoffrey Hinton, británico de 75 años conocido por ser una de las puntas de lanza principales del desarrollo de inteligencia artificial. El llamado 'padrino' de la IA, que trabajaba para Google, no solo ha dejado su puesto, sino que ha lanzado una advertencia sobre esta tecnología, afirmando que presenta riesgos terroríficos.

Hinton, así, se suma a la larga lista de magnates, intelectuales y empresarios del mundo de la tecnología que han lanzado el grito al cielo sobre la tecnología de inteligencia artificial. Ha anunciado su renuncia y ha dado a conocer su advertencia en una entrevista en el The New York Times, en el que ha asegurado que los peligros de la IA son "realmente aterradores".

Hablamos de toda una personalidad de la inteligencia artificial. Fue pionero en este campo, y fue conocido en 2012 después de que crease junto a dos estudiantes de posgrado de la Universidad de Toronto una tecnología que se acabó convirtiendo en la base intelectual de los sistemas de IA más grandes de la industria.

Quién es Geoffrey Hinton

Geoffrey llevaba trabajando en Google más de una década, y se convirtió en una voz con muchísima influencia en este sector. Tras dejar su empleo, Hinton explica que si "no lo hubiera hecho yo, alguien más lo habría hecho". Fue uno de los principales cerebros detrás del desarrollo de lo que hoy conocemos como redes neuronales. De hecho, él concibió dicha idea, que convirtió en el trabajo de su vida.

Ya en los 80, el que acabó siendo profesor de ciencias de la computación en la Universidad Carnegie Mellon, dejó su trabajo para irse a Canadá ante su negativa de que su investigación sobre redes neuronales fuera financiada por el Departamento de Defensa. No es para menos; Hinton se opone con firmeza contra el uso de la IA en el campo de batalla.

Geoffrey Hinton en una clase.

En 2012, Hinton desarrolla una red neuronal junto a Alex Krishevsky e Ilya Sutskever, estudiantes de la Universidad de Toronto, que podía analizar miles de fotos y aprender a identificar objetos cotidianos. Fundaron una startup que posteriormente sería absorbida por Google, después de una compra de 44 millones. Su sistema fue el catalizador para crear todo tipo de tecnologías, incluyendo las bases de los chatbots actuales. Esto le valió a Hinton el Premio Turing, el conocido como 'Nobel' de la computación.

Es aquí donde entran OpenAI y Google, así como otras tantas empresas interesadas en el desarrollo de las redes neuronales. Surgieron los modelos de procesamiento de texto, capaces de entender y generar lenguaje. En un principio Hinton no le dio más importancia, ya que pensaba que eran sistemas inferiores a las capacidades intrínsecas de los humanos. Cuando estos sistemas pudieron gestionar mayores cantidades de datos, su opinión cambió.

La advertencia de Hinton

"Mira cómo era [la tecnología de IA] hace cinco años y cómo es ahora. Toma la diferencia y propágala hacia adelante. Eso asusta". Así, Hinton define cómo teme que estos sistemas sean cada vez más poderosos, llegando a hablar sobre el riesgo que supone la aplicación de estas tecnologías en el campo de batalla. De esta forma, Hinton ha dejado su empleo de más de 10 años en Google, aunque no ha lanzado una crítica abierta a la compañía.

Pese a que Hinton no ha firmado ninguna de las cartas abiertas de líderes de la industria advirtiendo sobre la IA, no tiene palabras demasiado distintas a las enarboladas por personalidades como Steve Wozniak o Elon Musk. Asegura que es "difícil ver cómo se pueden evitar que los malos actores usen [esta tecnología] para cosas malas" y detalla cómo la desinformación podría ser un verdadero problema.

Hinton cree que Internet acabará inundado de fotografías, vídeos y textos completamente falsos. El usuario normal "ya no podrá saber qué es verdad" y teme que los chatbots puedan afectar enormemente al mercado laboral, destruyendo todo tipo de trabajos y sustituyendo empleos. "Se quita el trabajo pesado. Podría quitar más de eso".

Geoffrey Hinton en 2012 recogiendo el Premio Killiam en Ingeniería.

De esta forma, le preocupa que las versiones futuras de esta tecnología tengan comportamientos inesperados debido a la gran cantidad de datos que gestionan, llegando a permitir que estos sistemas generen su propio código y lo ejecuten por su cuenta. Se plantea la posibilidad de que las armas autónomas, similares a las vistas en películas de ciencia ficción como Terminator, acaben siendo reales.

Hinton explica que la idea de que estas cosas se puedan volver "más inteligentes que las personas" quedaba lejos. "Y pensé que estaba muy lejos. Pensé que faltaban entre 30 y 50 años o incluso más. Obviamente ya no pienso en eso". Basa parte de su argumento en la descontrolada carrera tecnológica que están teniendo Google y Microsoft por el liderazgo de la revolución de la IA.

El experto reconoce que este no es un escenario infalible, y que perfectamente podría ser imposible. Cree que la esperanza está puesta en la comunidad científica, capaz de controlar esta tecnología. "No creo que deban ampliar esto más hasta que hayan entendido si pueden controlarlo".