Logo de Qwen2.5-Max. Omicrono

DeepSeek ya tiene nuevos rivales: Alibaba lanza un modelo de IA que promete superar a todos sus rivales

El titán chino afirma que esta nueva solución de inteligencia artificial supera a las IAs de OpenAI, Anthropic y Meta en la mayoría de situaciones.

Más información: DeepSeek sufre un ciberataque: el rival de ChatGPT limita los registros de nuevos usuarios por un 'hackeo' a gran escala

El cómo una desconocida IA china ha podido desbancar a ChatGPT ha pillado a muchos en España por sorpresa. El auténtico bombazo de DeepSeek, la inteligencia artificial asiática que ha prometido superar a ChatGPT en capacidades y eficiencia, ha causado un auténtico terremoto que ha sacudido el tablero de la guerra por la IA. Incluso OpenAI ya ha acusado a la firma de usar sus modelos para entrenar DeepSeek. Tal ha sido el revuelo que ya hay rivales que han lanzado modelos de IA que afirman superar a DeepSeek.

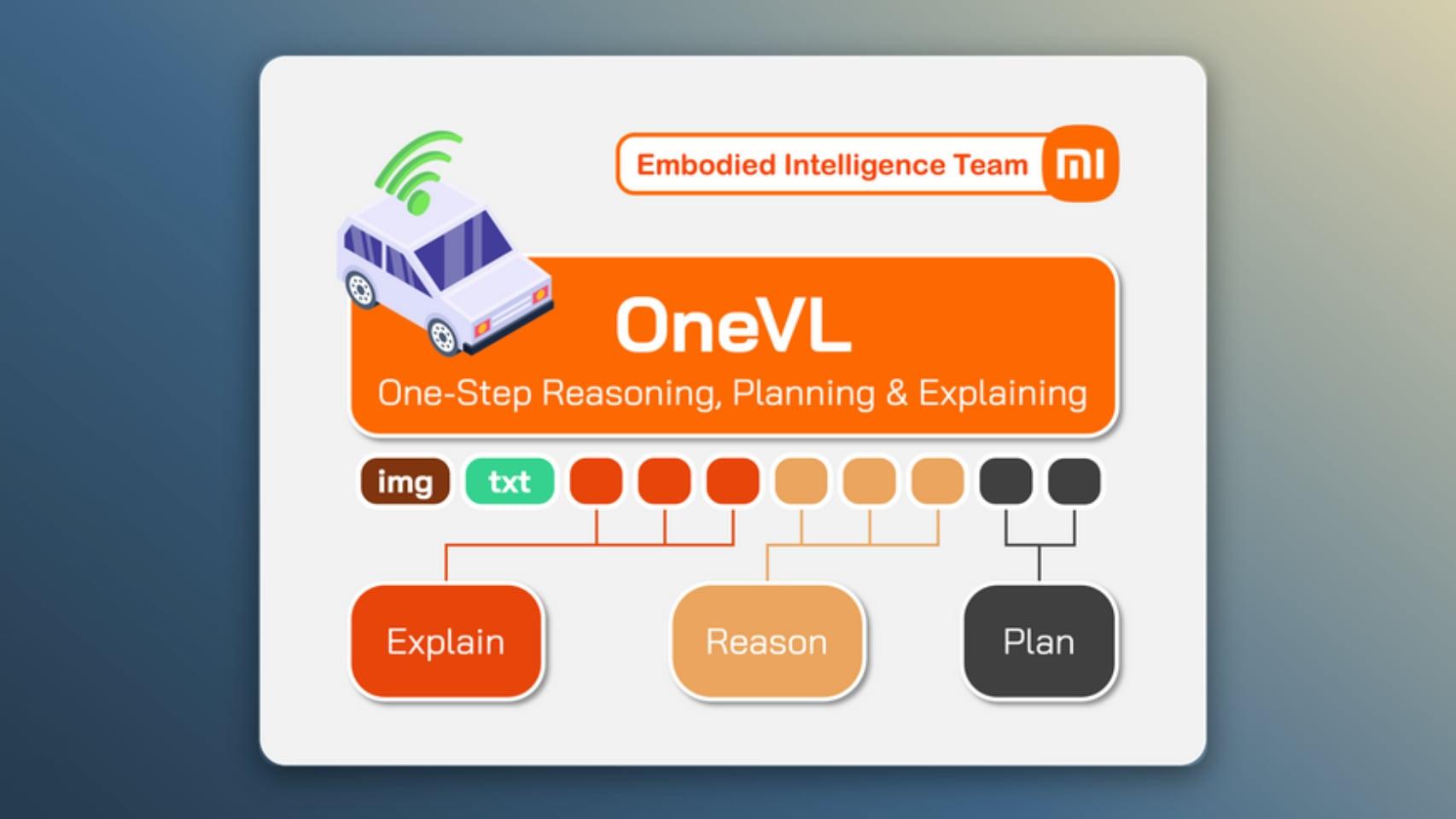

Es el caso de Alibaba, el titán tecnológico de China que en la víspera del Año Nuevo Lunar celebrado en el país ha lanzado Qwen2.5-Max, un modelo de inteligencia artificial que en sus palabras, puede no solo con DeepSeek-V3 (uno de los modelos más recientes de la empresa lanzado junto a DeepSeek-R1), sino que supera a GPT-4o y Llama-3.1-405B, los modelos de referencia de OpenAI y Meta, respectivamente.

Según la división de Qwen de Alibaba, Qwen2.5-Max es un modelo que supera en benchmarks a sus rivales GPT-4o, Llama-3.1-405B e incluso a Claude-3.5-Sonnet de Anthropic, otro de los modelos de vanguardia de la industria. Este modelo "supera a DeepSeek-V3 en pruebas de referencia como Arena-Hard, LiveBench, LiveCodeBench y GPQA-Diamond, al tiempo que demuestra resultados competitivos en otras evaluaciones, incluyendo MMLU-Pro", expone Alibaba en un comunicado.

Nuevos contrincantes de DeepSeek

Qwen2.5-Max es un modelo basado en el método Mixture of Experts (MOE), que implica dividir un modelo de IA en una serie de subredes separadas, calificadas como 'expertos'. Cada uno de estos 'expertos' está especializado en un subconjunto de datos de entrada, con el objetivo de que estos realicen tareas complicadas de forma conjunta. La idea es reducir lo máximo posible los costes de cálculo durante las fases de preentrenamiento y conseguir una mayor velocidad en los tiempos de inferencia.

Según Alibaba, este modelo ha sido entrenado en más de 20 billones de tokens y en su metodología incluye sistemas de ajuste SFT y aprendizaje RLFH (o lo que es lo mismo, aprendizaje de refuerzo a partir de retroalimentación humana). No solo eso; la API al completo del modelo ya se ha compartido en la nube de Alibaba. Los benchmarks realizados por Qwen revelan que efectivamente, en la mayoría de ocasiones su modelo queda ligeramente por encima de DeepSeek-V3.

The burst of DeepSeek V3 has attracted attention from the whole AI community to large-scale MoE models. Concurrently, we have been building Qwen2.5-Max, a large MoE LLM pretrained on massive data and post-trained with curated SFT and RLHF recipes. It achieves competitive… pic.twitter.com/oHVl16vfje

— Qwen (@Alibaba_Qwen) January 28, 2025

Tan solo un día antes, el equipo de Alibaba ya lanzó una nueva familia de modelos de IA, apodada Qwen 2.5-VL, capaz de realizar conjuntos de tareas de análisis de texto e imágenes. Dichos modelos pueden razonar sobre vídeos, detectar objetos en imágenes, analizar archivos e incluso controlar ordenadores, según expuso la propia Qwen en X (antes Twitter). Por supuesto, Qwen2.5-VL 72B también pudo superar a GPT-4o, Claude 3.5 Sonne y a Gemini 2.0 Flash en una variedad de pruebas.

Alibaba también ha dispuesto todo para lanzar su propio chatbot usando Qwen2.5-Max, apodado simplemente Qwen. La interfaz es prácticamente idéntica a las de DeepSeek y ChatGPT; se puede elegir uno de los modelos de Qwen dependiendo de lo que quiera el usuario, y se pueden subir archivos, buscar en Internet, generar vídeo, y un largo etcétera. En el futuro, podrá generar vídeo, como Sora de OpenAI.

Y es que la propia Qwen admite que el reciente impacto de DeepSeek V3, lanzado en diciembre del año pasado, ha causado una importante atención sobre los modelos de IA. De hecho, solo un par de días después de que DeepSeek lanzase R1, su modelo de razonamiento, la matriz de TikTok ByteDance también publicó actualizaciones en sus modelos de inteligencia artificial, afirmando por el camino haber superado a los modelos de OpenAI.

Básicamente, se ha desatado una auténtica guerra por el liderazgo de la IA en China. La naturaleza de código abierto, junto al modelo gratuito que tienen los modelos de DeepSeek (pese a sus problemas de privacidad) desencadenaron tal revuelo que numerosos rivales como la propia Alibaba impusieron importantes recortes de precios en sus modelos, según reporta Reuters.