Una de las habilidades más importantes que tenemos los humanos es el sentido del tacto. Gracias a él podemos, sin mirar, reconocer formas y objetos para que no tengamos que depender únicamente de la vista. Esta es una habilidad que los ingenieros en robótica desean extrapolar para sus máquinas, para que estas puedan ser mejores manipuladoras. Además, también serviría para que las prótesis fueran mucho más realistas y útiles.

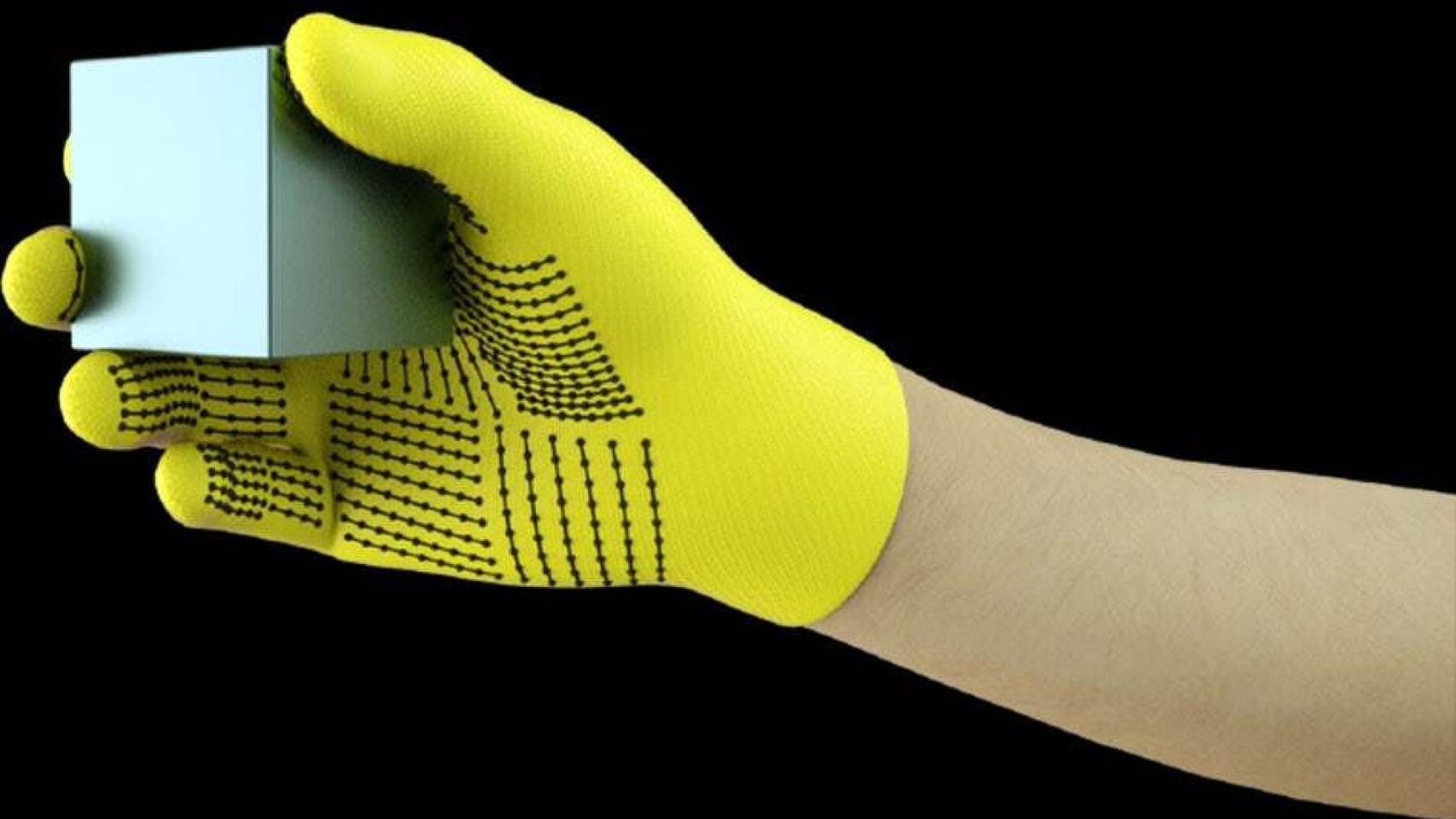

Los ingenieros del MIT han desarrollado un guante sensorial de bajo coste que es capaz de hacer esto posible. Gracias a este guante, la Inteligencia Artificial y los robots descubrirán cómo los humanos identificamos objetos al tocarlos. Exacto: les dotaría del sentido del tacto.

El guante del MIT para dotar del sentido del tacto a los robots

Los ingenieros del MIT han llamado a este guante el Scalable Tactile Glove (STAG), que usa 550 sensores de presión diminutos para generar patrones para que los robots y la IA puedan reconocer aquello que están tocando. La idea detrás de este guante es reunir la mayor cantidad de información posible sobre cómo los humanos somos capaces de identificarnos mediante el tacto.

Con la base de datos suficientemente grande por detrás, el aprendizaje autómatico podría implementarse para realizar análisis y deducir no solo cómo una mano humana puede identificar algo, sino también para estimar su peso o sus dimensiones. Esta es la gran falla de los robots y las extremidades protésicas, y la creación de este guante le haría mucho bien a esta tecnología.

robot

Este guante de bajo coste puede recopilar estos mismos datos gracias a estos 550 sensores de presión instalados en él. El guante a su vez está conectado a un ordenador que es el que recoge los datos y las mediciones de presión se convierten en una especie de “mapa táctil” en vídeo. Todo este material se manda a una red neuronal convolucional (CNN) que clasifica las imágenes para encontrar patrones de presión específicos y compararlos con los objetos que toque el guante.

Para este fin, los ingenieros del MIT reunieron 135.000 pedazos de vídeo de 26 objetos comunes como latas, tijeras, cucharas, bolígrafos, pelotas de tenis, tazas, etcétera. Esta red neuronal hizo coincidir los marcos semi-aleatorios con los tactos específicos hasta que se formó una imagen completa de un objeto. Mediante el uso de imágenes semi-aleatorias, la red puede recibir grupos de imágenes relacionados para que no pierda tiempo en datos irrelevantes adversos.

sensor-glove-1

Gracias a estos avances este sistema identificó objetos con una precisión de un 76 por ciento, y además ayudó a los investigadores a comprender cómo la mano agarra y manipula un objeto. Para, por ejemplo, estimar el peso con una precisión de aproximadamente 60 gramos se compiló una base de datos separada de 11.000 trozos de vídeo que muestran los objetos que se recogen con los dedos y el pulgar antes de dejarlos caer. Si se mide la presión de la mano mientras se sostiene el objeto y luego se compara después de la caída, se puede medir el peso.

Como hemos dicho, estos sistemas son de “bajo coste”. Guantes con estos sensores similares cuestan miles de dólares, mientras que el del MIT usa materiales de venta que podremos encontrar en cualquier lugar para la confección del guante. Este material cuesta únicamente 10 dólares, por lo que gracias al bajo coste este sistema se podría volver muy accesible para quién quisiera usarlo en su campo. Los robots, la Inteligencia Artificial y las prótesis conseguirían sentido del tacto por un precio irrisorio. Un avance importante y muy bien recibido.

Imagen de portada | MIT