El cerebro sigue siendo uno de los órganos más desconocidos, a pesar de los contínuos avances en neurociencia, que en los últimos años no ha dejado de proporcionar nuevos descubrimientos, también en España. En ese sentido, algunas de las iniciativas más esperanzadoras tienen que ver con las interfaces cerebro-ordenador a través de proyectos como Stentrode, el implante cerebral que sirve para enviar mails con la mente y tratar el párkinson, o el que ha conseguido que un paciente con ELA avanzado pueda volver a comunicarse.

Uno de los más esperados, más por el márketing que rodea a Elon Musk que por su verdadero potencial, es Neuralink, con el que hace unos años el fundador de Tesla mostró a monos jugando a videojuegos y que esta misma semana ha vuelto a retrasar hasta finales de noviembre. Sin embargo, el más decisivo puede ser el que acaba de presentar un equipo de la Universidad de Texas, que en un artículo científico publicado en bioRxiv detalla el desarrollo de un algoritmo que puede 'leer' las palabras que una persona está escuchando o pensando sin necesidad de un implante o cirugía invasiva.

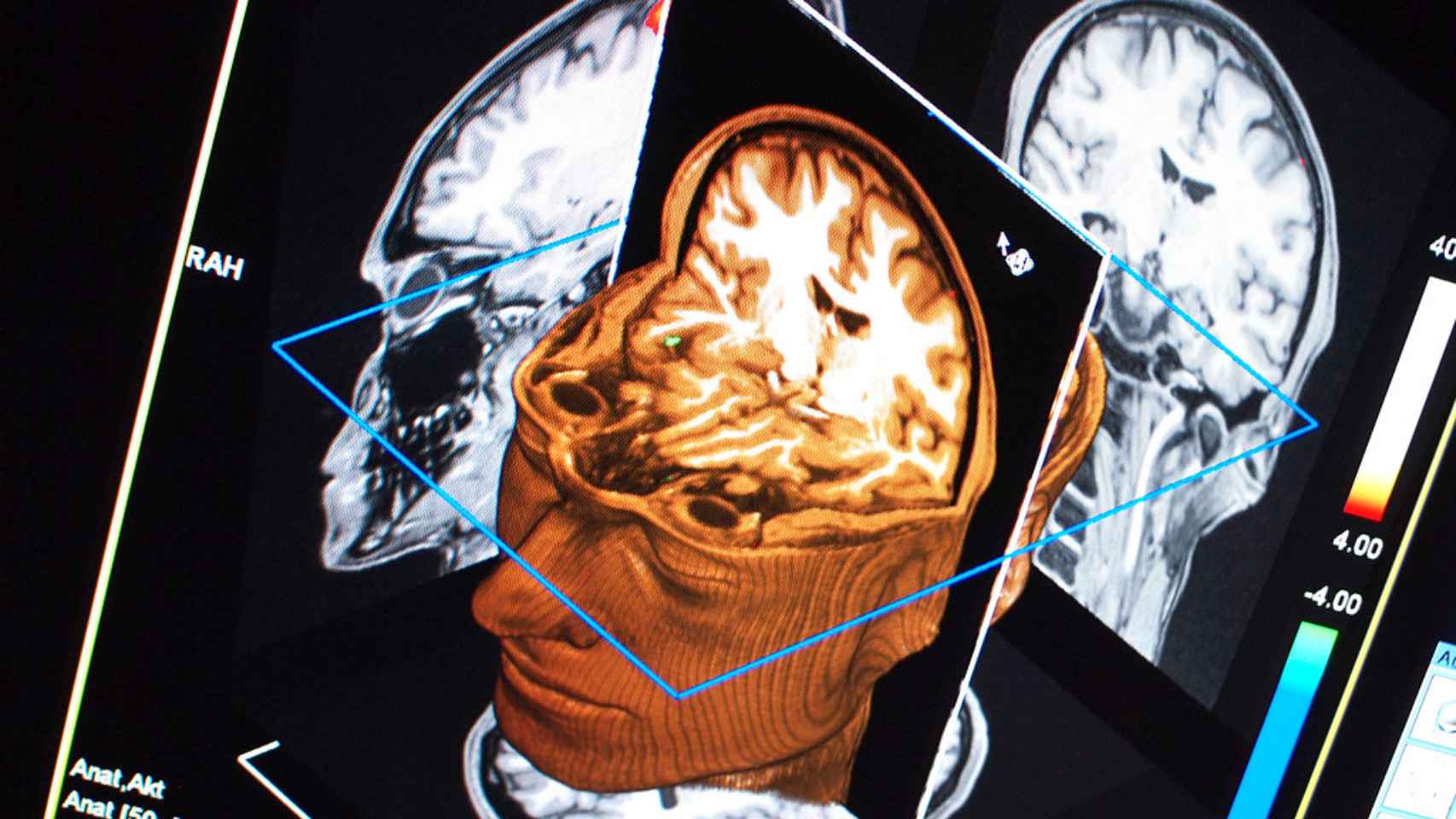

Y es que, aunque otros científicos ya habían logrado reconstruir lenguaje e imágenes a partir de señales procedentes de implantes cerebrales, este nuevo decodificador funciona durante grabaciones cerebrales por resonancia magnética funcional (fMRI, por sus siglas en inglés), esas grandes máquinas en las que se realizan escáneres. Es un gran hallazgo que abre nuevas posibilidades para el desarrollo de tecnologías de asistencia para quienes no pueden hablar o teclear, pero también plantea numerosas preocupaciones éticas sobre la privacidad.

Cómo funciona

En lugar de centrarse en descifrar palabra por palabra, el sistema ideado por Alexander Huth, neurocientífico de la Universidad de Texas en Austin y coautor del estudio, trata de discernir el significado de alto nivel de una frase o pensamiento. Así, no traduce con exactitud literal cada enunciado, sino que consigue transmitir la idea general de lo que se piensa con bastante precisión. "Si hace veinte años le hubieras preguntado a cualquier neurocientífico cognitivo del mundo si esto era posible, se habría reído de ti", afirma Huth en The Scientist.

Para entrenar su algoritmo, Huth y el resto del equipo de neurocientíficos utilizaron grabaciones cerebrales de fMRI, que miden los cambios en el flujo sanguíneo dentro del cerebro como indicadores de la actividad cerebral. Estas grabaciones fueron realizadas mientras tres sujetos del estudio —una mujer y dos hombres, todos entre los 20 y 30 años— escuchaban 16 horas de distintos podcasts, entre ellos varias charlas TED, y audiolibros.

Una paciente se somete a una resonancia magnética

Era importante que los sujetos escucharan el mayor número posible de medios distintos, para poder construir un 'decodificador' lo más preciso posible y aplicable a los conceptos y situaciones más diversos. Analizando esas 16 horas de cambios en los flujos sanguíneos del cerebro de cada individuo, el algoritmo realizó una serie de predicciones de cómo serían futuras lecturas de las resonancias magnéticas. Luego, estas 'suposiciones' se cotejaron con la grabación de fMRI en tiempo real, y las que más se acercaban a las lecturas reales iban determinando las palabras que el descodificador finalmente generaba.

Realizado este proceso de depuración, los investigadores iban puntuando la similitud de los estímulos presentados al sujeto con lo que generaba el 'descodificador'. Los resultados indicaron que el algoritmo acababa generando una historia completa a partir de las grabaciones de fMRI que coincidía "bastante bien", según Huth, con la historia narrada por el podcast o audiolibro de turno.

Sin embargo, no siempre daba en la diana, ya que todavía quedan algunos defectos por pulir. Por ejemplo, al algoritmo no se le dan especialmente bien los pronombres y a menudo confunde la primera y la tercera persona. "Sabe lo que está pasando con bastante precisión, pero no quién está haciendo las cosas", afirma Huth. Esto puede deberse también a las peculiaridades del idioma inglés, ya que no tiene género gramatical y tiende hacia el lenguaje neutro.

Posibles aplicaciones

El potencial de aplicación de este descubrimiento es enorme, ya que, al contrario que los sistemas conocidos hasta ahora, no implica compejas cirugías ni la necesidad de implantar ningún dispositivo en el cerebro. Lo más difícil es reducir el gasto y los inconvenientes de utilizar las grandes máquinas de resonancia magnética, pero es un reto que Huth y su equipo están dispuestos a asumir.

El magnetoencefalograma que permite moverse durante la prueba

Y es que existen alternativas de neuroimagen como la magnetoencefalografía (MEG), otra técnica similar que permite registrar los campos magnéticos que producen las corrientes eléctricas del cerebro. Sin embargo, esta tiene un potencial más portátil y preciso que la fMRI, lo que podría ser la llave junto al 'descodificador' desarrollado por estos científicos de la Universidad de Texas para que personas con parálisis o en estados avanzados de ELA puedan comunicarse.

Más allá de sus aplicaciones prácticas, lo importante es el nuevo conocimiento que ofrece este proyecto acerca de cómo funciona el órgano que gestiona la actividad de nuestro sistema nervioso. Los resultados del estudio revelan, por ejemplo, qué partes del cerebro son las encargadas de la creación de significado. Entre sus conlcusiones figura que dos regiones del cerebro que aparentemente se ocupan de aspectos distintos, como la corteza preforntal y la corteza temporal parietal, reperesentaban la misma información para el descodificador, que funcionaba igual de bien utilizando grabaciones de cualquiera de las dos áreas.

Un técnico de neuroimagen estudiando un escáner cerebral

El algoritmo tampoco se limitaba a identificar los estímulos verbales. Aunque fue entrenado con sujetos que exclusivamente escuchaban lenguaje hablado, los científicos probaron su eficacia proyectando una película muda durante uno de los experimentos. El decodificador consiguió reconstruir con éxito lo que ocurrría, además de la experiencia imaginaria de un participante al contar él mismo una historia en lugar de escucharla. "El hecho de que esas cosas se solapen tanto [en el cerebro] es algo que estamos empezando a apreciar", concluía Huth.

Privacidad mental

Para asegurarse de que no se utilice su descubrimiento con fines que vayan más allá de la investigación o la ayuda para personas que sufren algún tipo de parálisis y no pueden comunicarse, los neurocientíficos responsables de este estudio realizaron varias pruebas para confirmar que no funciona sin la cooperación voluntaria del participante.

[DARPA crea el primer brazo protésico controlado por la mente que permite recuperar el tacto]

Para comprobarlo, mientras se reproducía el audio los investigadores pidieron a los sujetos que se distrajeran realizando otras tareas mentales, como contar, enumerar animales o imaginar una historia diferente a la que estaban escuchando. De todas ellas, la estrategia más eficaz para confundir al algoritmo y que este diera lecturas inexactas fue, curiosamente, la de pensar en animales.

También llegaron a la conclusión de que un decodificador entrenado con los escáneres cerebrales de un sujeto no servía para los demás, así que sería necesario que alguien participara en largas sesiones de preparación antes de que el algoritmo fuera eficaz a la hora de leer sus pensamientos con precisión. Aún así, los siguientes desarrollos de esta tecnología pueden acercar cosas que hasta hace poco veíamos como distópicas, como la posibilidad de que haya soldados con telepatía para recibir órdenes directamente en el cerebro.

También te puede interesar:

- Un grupo de neuronas aprenden a jugar al Pong para estudiar el impacto de las drogas en el cerebro

- El mapa del cerebro más detallado hecho nunca es de Google

- La prótesis del habla: el 'chip' que traduce señales del cerebro en palabras

- El creador de Steam quiere conectar tu cerebro a los videojuegos del futuro