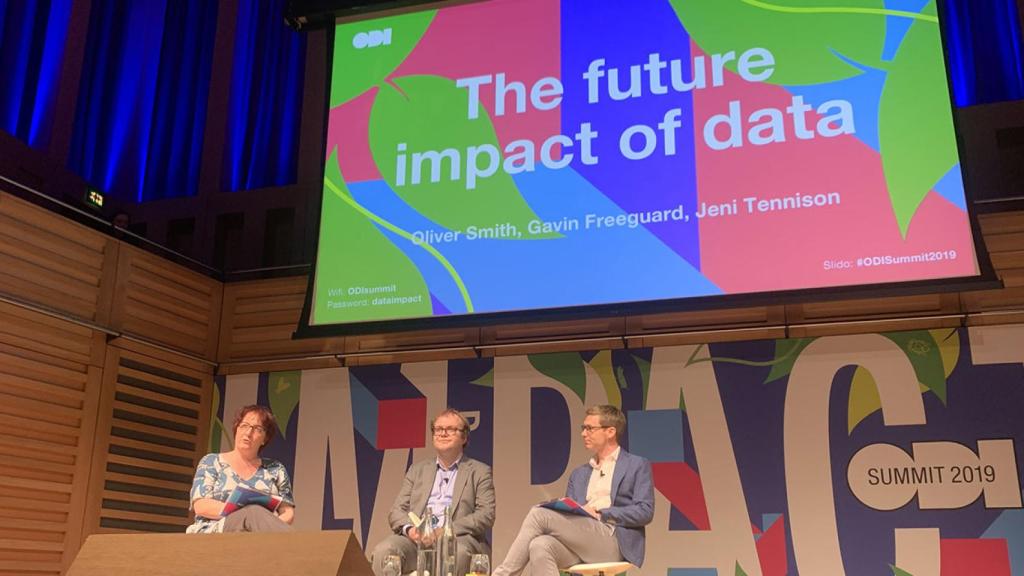

El director de Estrategia en Telefónica Innovación Alpha, Oliver Smith, en la mesa de conclusiones del evento de Open Data Institute.

Adiós a la “inevitabilidad”, el “datopolio” es vencible

El creador de la web, Tim Berners-Lee, y otros expertos reclaman más ética en la recolección y uso de datos, más apertura y tecnologías explicables. Datos como bien común y confianza como base para el impacto

17 noviembre, 2019 07:00En la misma semana en la que se ha revelado que Google ha estado recopilando sin permiso historiales clínicos de millones de pacientes, el Open Data Institute (Instituto de Datos Abiertos) fundado por Tim Berners-Lee y Nigel Shadbolt, ha celebrado su encuentro anual. Ambos han criticado el contexto de escándalo tras escándalo acerca del cuestionable uso de datos por parte de los gigantes tecnológicos (los GAFA y otros) y del funcionamiento discriminatorio de algoritmos, como el de Apple Pay, sin ir más lejos. “Estoy seguro de que hay más por venir. El problema es que no sabemos cuáles son y serán los efectos, que se darán a gran escala”, aseguraba Shadbot en su intervención inicial.

El también profesor de Informática y de Inteligencia Artificial (IA) en las universidades de Oxford y de Southampton (Reino Unido) ha reclamado una moratoria de emergencia en anuncios políticos: “No podemos arriesgarnos a desestabilizar más la democracia. Necesitamos proceder con precaución”. Shadbot critica que los “datopolios” quieren dar una sensación de privacidad a la gente cuando en realidad lo que quieren es tener el monopolio de sus datos, convertir a las personas en productos.

El experto sostiene que el tipo de interés detrás de cada empresa u organización para tener nuestros datos se está volviendo “realmente importante” a medida que avanzan la IA y la ciencia de datos. “Si hay algoritmos que no podemos entender necesitamos encontrar una manera de hacer que rindan cuentas”, afirma. “La gente habla mucho sobre ética pero es un problema real encontrar maneras razonables de que estas tecnologías florezcan en ese contexto”, añade.

En esta línea, el director de Estrategia en Telefónica Innovación Alpha, Oliver Smith, asegura que es necesario un equilibrio entre tecnología avanzada y explicabilidad. “Decir que tienes una tecnología genial pero no puedes explicar cómo funciona no es aceptable”, afirma. Alpha está desarrollando un asistente de salud personal digital para ayudar a las personas a cambiar sus comportamientos y hábitos cotidianos. Para ello, quieren ser capaces de usar algoritmos precisos y avanzados como las redes neuronales (aprendizaje profundo), que precisamente debido a su complejidad son difíciles de explicar. Para ser capaces de entenderlos, trabajan en un sistema que traduce ese tipo de algoritmos en una explicación simplificada, que han presentado en el evento de ODI como tecnología licenciable.

Smith ha comentado que esto forma parte del marco ético que han diseñado e implementado internamente en Alpha, que aplican también a aspectos como rediseñar sus políticas de privacidad y términos y condiciones para hacerlos más transparentes y comprensibles, o desarrollar tecnologías que eviten sesgos, que no discriminen, y también que preserven, por defecto, la privacidad. “Aspiramos a tener la mejor tecnología y el mejor producto posible sin necesidad de recopilar datos personales de los usuarios”, afirma. Su trabajo está siendo auditado por la consultora de ética Eticas Research & Consulting.

Smith señala que hay mucho por hacer y que no tomar una decisión -no actuar, ignorar, decidir no conocer- es en sí una decisión ética. “Puedes cometer errores pero el único que no puedes cometer es el de no pensar en ello, o te quedarás atrapado”. Su conclusión: “No tendremos impacto sin confianza. Necesitamos pensar en los fundamentos de cómo construimos esa confianza a través de la transparencia, la rendición de cuentas, la precisión, y la justicia. Es hora de empezar”.

Qué opina la gente

Sobre justicia se habló también en otra de las sesiones del evento de ODI. Partiendo de la base de que los datos son infraestructura, una parte integral de nuestras vidas, ¿cómo podemos garantizar que se usen de manera justa y que las personas tengan influencia sobre cómo se recopila, usa y comparte su información personal? Carly Kind, directora del Instituto Ada Lovelace, señaló cuán injusto puede ser aplicar algoritmos discriminatorios [aunque no lo sean intencionalmente] como el de Apple Pay en sistemas de asignación de recursos públicos (quién recibe la renta básica, ayudas a la dependencia, pensiones…).

“Hay mucho en juego”, asegura Kind. El Instituto Ada Lovelace busca evidencias del impacto ético y de cómo las expectativas públicas influyen en el desarrollo de tecnologías, y cuán informada es la conversación pública. “Lo peor es que la gente tiene una sensación de inevitabilidad de la tecnología y de que, como miembro del público, no tiene nada que decir al respecto”.

“No podemos quedarnos estancados en el discurso de la inevitabilidad”, afirmaba también Michael Veale, académico especialista en Derechos Digitales en University College London (UCL). Veale señaló que hay “una tendencia muy fuerte de asimetrías de poder”. “Te hacen consciente de que eres solo una pequeña persona versus la enorme máquina de hacer dinero”, asegura. También sostiene que las políticas de consentimiento y de transparencia no funcionan y que, por tanto, es necesario politizar la equidad. “Cuando hablamos de ética, de justicia o de discriminación en relación con los datos, estamos hablando de infraestructura, y estas conversaciones son totalmente controladas por los lobbies. Se evita o neutraliza cualquier discusión sobre la infraestructura subyacente que permite la ejecución de una gran organización y mantiene su poder”, afirma.

Datos abiertos, o no

¿Qué piensan las personas de a pie? Varios representantes de ODI presentaron el informe About data about us, una nueva encuesta a consumidores de Reino Unido. Los resultados: casi nueve de cada 10 adultos sienten que es importante o muy importante que las organizaciones con las que interactúan utilicen sus datos de manera ética, algo que, en opinión del 44% deberían garantizar el Gobierno y los reguladores.

“Los usuarios quieren decidir cómo funciona su compromiso y ser capaces de decir ‘no’ cuando no es justo. Les preocupa que se hagan inferencias de cosas sobre las que no tienen control”, comentó Renate Samson, asesora sénior de ODI. El informe también desmitifica -dice- que las personas sean unas completas analfabetas en datos. “Se cree que la gente no se preocupa por los datos pero es al contrario. Conocen los aspectos negativos y tienen cierto miedo, pero también conocen el lado positivo y cómo la ciencia de datos ha impactado positivamente en sus vidas”, afirma. Desde ODI señalan al respecto que es injusto generalizar lo que piensa la gente y que son necesarias conversaciones más profundas.

ODI, como instituto de datos abiertos, promueve obviamente las políticas e iniciativas de datos compartidos, y hablaron de cómo las empresas y organizaciones se pueden beneficiar de forma tanto tangible como intangible de este tipo de políticas. ¿Es difícil hacer que los negocios abran sus datos? Tanto Shadbot como Berners-Lee coinciden en que sí. “Hay de todo, quienes comparten y quienes poseen y se abrazan a sus datos. Y, cuando dejan de hacerlo, obtienen beneficios que no esperaban”, afirma el creador de la WWW.

Shadbot puntualiza que esto se debe en parte al efecto de red, y que ya “se ha demostrado -en sectores como el de la salud- que “todo el mundo gana en un marco datos abiertos, donde los diferentes actores implicados obtienen más valor de ellos”. Ambos defendieron que “los datos no son el nuevo petróleo” sino un bien común, y que es imprescindible que se usen de forma ética y abierto “para aumentar a las personas, en lugar de oprimirlas”.