Los deepfakes o vídeos falsos hechos con inteligencia artificial están convirtiéndose en un fenómeno en España y en el resto del mundo. Hay sentimientos divididos, que creen que servirá para aplicaciones sociales y científicas y otros que creen que serán todo un peligro que alimentará la desinformación que ya sufrimos. Pero hay trucos para 'pillarlos'.

Y es que los deepfakes, por muy elaborados que sean, no dejan de ser creaciones artificiales. Científicos informáticos de la Universidad de Buffalo han desarrollado una herramienta que es capaz de detectar estos vídeos mediante un truco muy ingenioso: mirar los ojos de la persona en el vídeo. Aquí puedes leer el documento completo del estudio.

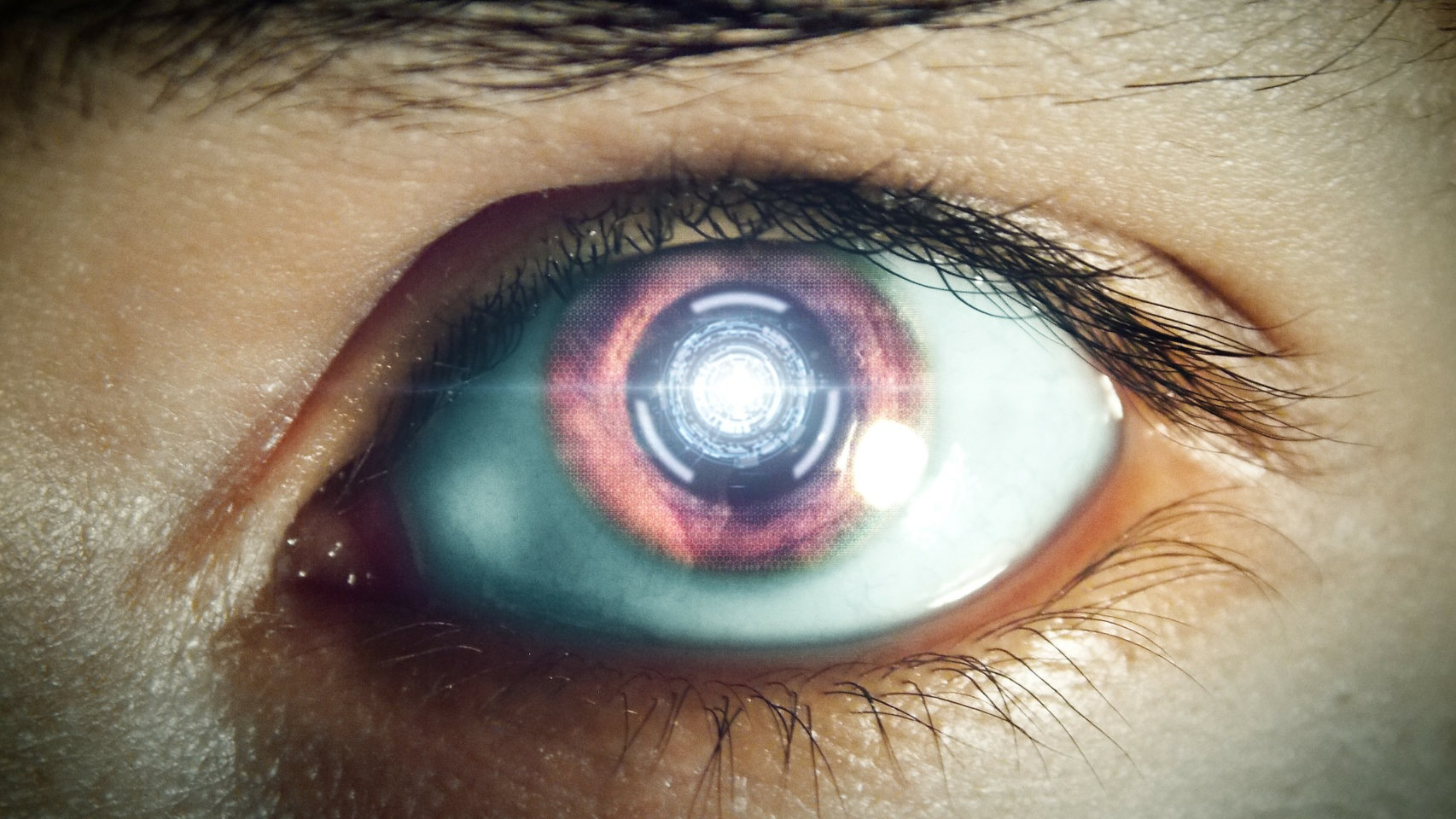

La clave está en cómo se refleja la luz en los ojos. Este sistema, con una tasa de efectividad del 94% en la detección de los deepfake, analiza los efectos de la luz en los ojos de los sujetos de los vídeos para determinar si son realistas o no.

La clave está en los ojos

Captura de pantalla del sistema detectando las inconsistencias de luz de los ojos de un deepfake.

Este sistema analiza más concretamente las córneas de los ojos, que tienen una superficie que refleja la luz de una forma similar a cómo lo haría un espejo. La idea es determinar si los patrones reflectantes de la luz, valga la redundancia, reflejados en los ojos concuerdan con la realidad.

Usando la lógica, si tomamos como ejemplo una foto hecha a una persona con una cámara, veremos que el reflejo de los ojos será muy parecido en los dos, ya que están viendo los mismos. Los deepfakes suelen saltarse los detalles más pequeños, ya que no son capaces de lograr esta clase de detalles tan variables.

Lo vimos, por ejemplo, en el caso del tiktoker responsable de los deepfakes de Tom Cruise jugando al golf; aunque a simple vista da totalmente el 'pego', si nos fijamos con lupa veremos cómo algunas partes de la silueta de la cara se distorsionan por el movimiento de la persona que usan de modelo.

Irónicamente, es de nuevo la inteligencia artificial la que en esta ocasión se encarga de buscar el error, analizando el rostro y la luz reflejada en cada uno de los globos oculares, buscando estas inconsistencias. Una vez lo hace, genera una puntuación de similitud; cuanto menor sea la puntuación, más probable será que el rostro de la imagen sea un deepfake.

Los investigadores usaron como ejemplos deepfakes de la famosa web This Person Does Not Exist, un repositorio de imágenes creadas a partir de la arquitectura StyleGan2. No es perfecta; los propios desarrolladores explican que tiene sus limitaciones, como el hecho de que las inconsistencias lumínicas de estas imágenes se pueden corregir con postprocesamiento manual.

Además de que sólo se ha demostrado su funcionalidad en retratos, esta IA sólo es capaz de determinar las inconsistencias ya mencionadas en los ojos del sujeto. Si estos no se muestran, el sistema no funcionará. De hecho, si el sujeto no mira a cámara, es probable que el propio sistema de falsos positivos. Por supuesto, todo esto se está investigando para futuras versiones, pero lo importante es que no podrá detectar los deepfakes más elaborados (pero sí los más básicos).

También te puede interesar...

- Microsoft y Oracle muestran sus cartas para llevar la IA hasta el 'edge computing'

- Esta web convierte fotografías viejas en vídeos que 'devuelven la vida' a quien sale en ellas

- Lo nuevo de Panasonic es un robot gato dentro de un calcetín que se tira pedos