oculus-intel-1

Oculus, el robot de Intel que prueba pantallas táctiles para los humanos

Noticias relacionadas

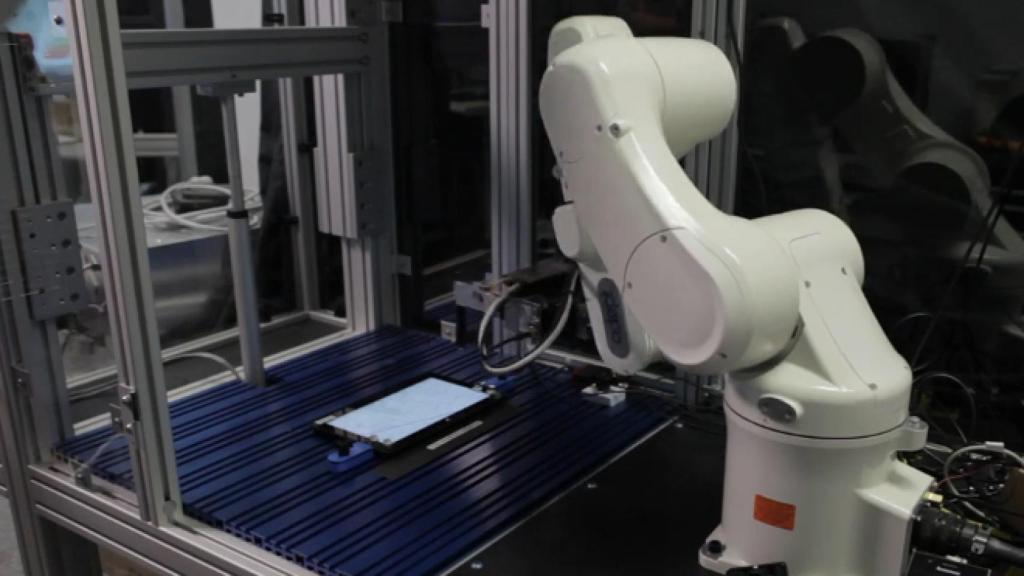

Para la mayoría de los que usamos smartphones, ya es natural tocar la pantalla y que se produzca una reacción natural a nuestras acciones. Si navegamos por los menús, esperamos que tocar los botones haga que se activen, y que los gestos muevan el texto que estamos leyendo; si estamos dibujando, esperamos que la línea siga correctamente el camino que le dictamos. Pero aunque ahora esto parezca natural, en realidad lo es gracias a innovaciones como Oculus, el robot de Intel encargado de probar pantallas táctiles.

Tecnología de Hollywood

oculus-intel-4

La misión de Oculus no es simplemente probar si una pantalla funciona, sino asegurarse de que se “siente” como debería. Para ello, se dedica a hacer exactamente lo mismo que hacemos cuando tenemos nuestro smartphone delante, probablemente perder el tiempo con un juego como Cut the Rope. Pero para Oculus no es perder el tiempo: con una cámara sacada de los mejores estudios de Hollywood capaz de grabar vídeo a 300 frames por segundo en resoluciones superiores a la HD, analiza la respuesta de la pantalla a cada acción que produce en el juego.

Dedos robóticos pero “humanos”

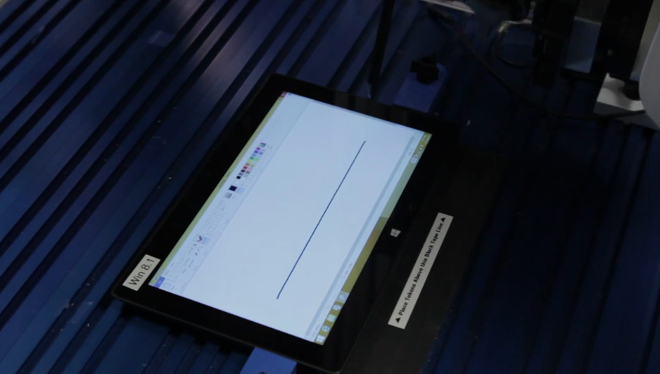

Con sus dos “dedos” realizando todo tipo de acciones, Oculus no solo juega; también prueba a escribir en el teclado para asegurarse de que se introducen las palabras que quería introducir, o simplemente navega por una página web, “tirando” hacia arriba y hacia abajo buscando la velocidad y el “rebote” correcto en la interfaz.

oculus-intel-2

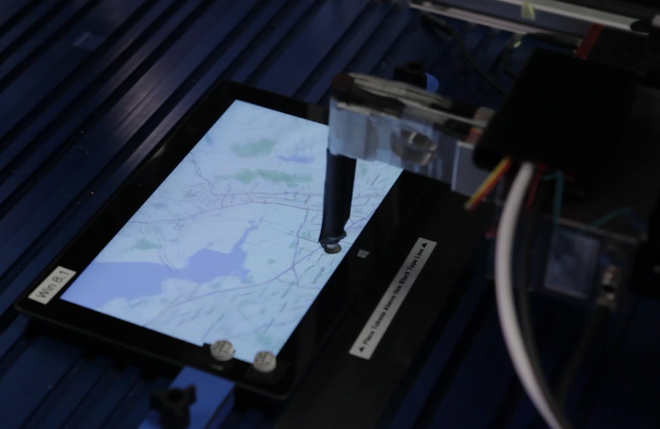

El resultado es una serie de números, una puntuación que se compara con los estudios realizados por Intel sobre cómo queremos que la interfaz responda a nuestros gestos. Estos estudios consistieron en probar diversas pantallas con varios niveles de respuesta; aunque lo lógico sería pensar que cuanta mejor sea la respuesta mejor será la experiencia, no siempre tiene porqué ser así.

Mejor respuesta no implica una mejor experiencia

oculus-intel-3

A veces esperamos un retraso en ciertas acciones, aunque no nos demos cuenta de ello, y no sepamos decir exactamente porqué no nos gusta la pantalla. Por ejemplo, Intel asegura que cuando usamos una pantalla táctil esperamos un retraso de unas decenas de milisegundos, pero si pasamos a usar un lápiz capacitivo (un stylus), de repente deseamos una mejor respuesta, de apenas un milisegundo de retraso. Igualmente, estas cifras varían si estamos hablando de un veterano en este tipo de dispositivos o de alguien que los usa por primera vez en su vida.

Los robots, los futuros “beta testers”

Para poder adaptarse a todas estas situaciones, Intel cuenta ya con tres Oculus en funcionamiento, y está terminando la construcción de un cuarto. El siguiente paso, aseguran, son robots que puedan probar aplicaciones en busca de bugs o de fallos en su interfaz. Normalmente esta tarea la ejecutan los llamados “beta testers”, pero por muchas personas que contrates para que prueben tu app, es inevitable que algún bug llegue a la versión final. Este tipo de robots podrían probar apps durante horas en todas las combinaciones posibles.

Fuente | MIT Technology Review