Fotomontaje con un teclado y una ilustración de una IA.

La inteligencia artificial que puede robar tus contraseñas escuchando las teclas de tu ordenador

El experimento plantea un futuro en el que las inteligencias artificiales podrían registrar nuestras pulsaciones en el teclado y robar nuestros datos.

7 agosto, 2023 16:59La inteligencia artificial ha sido catalogada como revolucionaria tanto en España como en el resto del mundo. Sus impresionantes capacidades han puesto de manifiesto sus múltiples usos en todo tipo de campos, pero también han causado el temor de una comunidad científica que ve un arma demasiado poderosa en manos no deseadas. La última prueba de esto es un modelo de deep learning capaz de robar datos a través de pulsaciones de un teclado.

Tal y como recoge BleepingComputer, investigadores de Cornell en Reino Unido han conseguido desarrollar un modelo de aprendizaje profundo capaz de robar datos provenientes de las grabaciones de las pulsaciones de un teclado. Es decir, un micrófono registra estas pulsaciones y el modelo es capaz de robar datos basándose en dichas pulsaciones. Lo terrorífico es que es tremendamente preciso, con una tasa de acierto del 95%.

El paper de la investigación en el que se explican todos los detalles sobre el entrenamiento de estos modelos revela cómo esta IA es capaz de interpretar la entrada de estas teclas usando únicamente el audio. Si bien estos resultados podrían tardar en aplicarse a un escenario real, la propia investigación propone sistemas y métodos para evitar ser víctima de estos ataques.

Una IA robando datos

El equipo, liderado por Joshua Harrinson, Maryam Mehrnezhad y Ehsan Toreini, pudo entrenar un algoritmo de clasificación de audio con unas capacidades bastante impresionantes. Los investigadores registraron las pulsaciones de teclas en un teclado muy concreto, el de un MacBook Pro moderno, usando un micrófono cercano. También se usó un iPhone 13 mini colocado a 17 centímetros del ordenador y la aplicación de videollamadas Zoom.

¿Por qué se usaron estos dispositivos para registrar las teclas de este teclado? Y más concretamente ¿por qué se usó un MacBook Pro? Nada de esto es casual; el MacBook Pro usado en este experimento tiene el mismo teclado que los modelos de MacBook de los últimos dos años, por lo que un posible escenario en el que se usara este modelo podría tener un impacto considerable en un buen número de usuarios.

Figura que muestra la precisión Arxiv

Respecto al iPhone y a Zoom, la explicación es sencilla. Un hacker podría atacar directamente a los smartphones de ciertos usuarios y hacerse con el control de su micrófono para así registrar el tecleo del portátil. Un interlocutor con malas intenciones por Zoom también podría usar la aplicación para grabar las teclas usando o bien el micrófono del ordenador o el de los auriculares asociados al mismo.

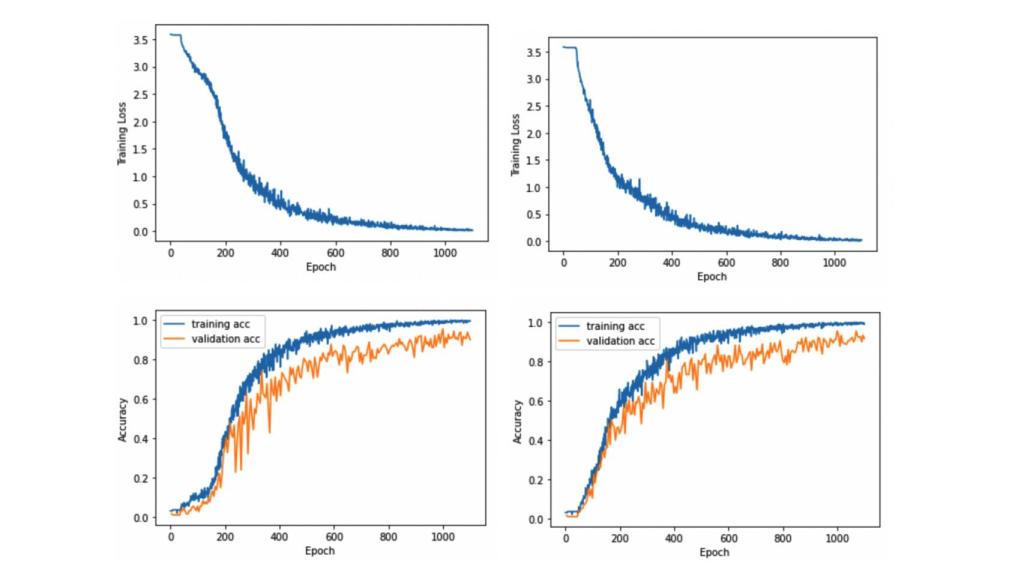

De esta forma, los investigadores recopilaron datos presionando hasta 36 teclas de un MacBook Pro 25 veces cada una, recogiendo el sonido producido por cada una de estas pulsaciones. Produjeron formas de onda y espectrogramas a partir de estas grabaciones, revelando diferencias palpables para los sonidos de cada tecla.

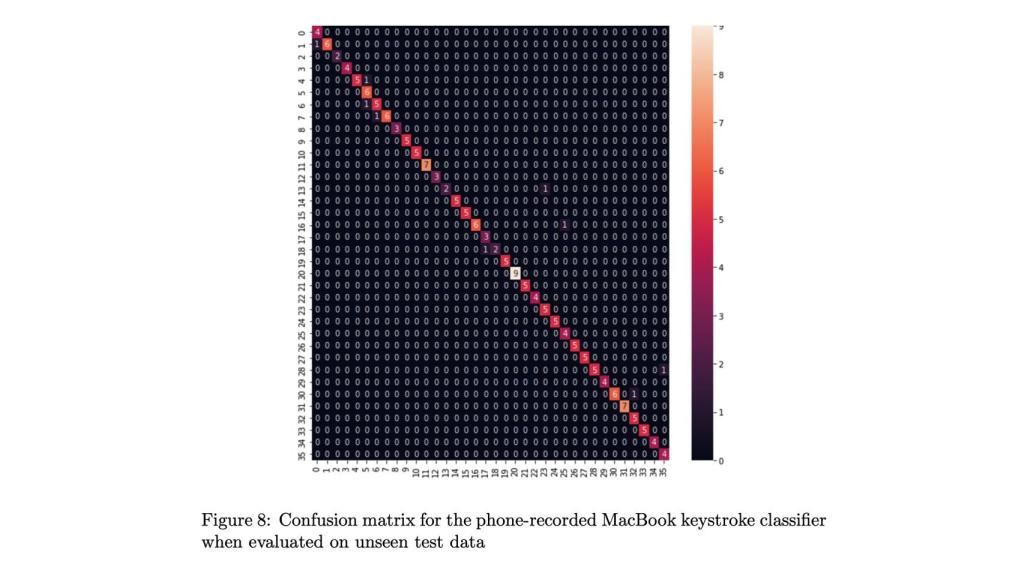

Matriz que revela el grado de confusión para el clasificador con grabaciones del iPhone 13 Arxiv

Procesaron todos estos datos aumentando las señales que se pueden usar para identificar las pulsaciones de estas teclas. Estas imágenes del espectrograma se usaron para entrenar a CoAtNet, un clasificador de imágenes, al cual se le añadieron ciertos datos de experimentación para conseguir una mejor tasa de precisión en los resultados.

Así, los investigadores procedieron a usar CoAtNet para clasificar cada una de las pulsaciones. Se logró una precisión del 95% en grabaciones usando un smartphone, y en el caso de Zoom la precisión bajó hasta el 93%. El porcentaje bajó hasta un mínimo del 91,7% a la hora de usar Skype, un número que sigue siendo muy usable para escenarios problemáticos.

¿Es aplicable a la vida real?

Lógicamente, es difícil pensar en que este modelo acabe siendo usado de forma extendida en la actualidad, o al menos a corto plazo. Sin embargo, este experimento dibuja uno de tantos escenarios problemáticos para la inteligencia artificial; tanto es así, que hasta los investigadores en el paper detallan maneras para 'confundir' al modelo CoAtNet.

Visless V84. Omicrono

Uno de los más obvios sugiere alterar los estilos de escritura o usar contraseñas completamente aleatorias. Otras medidas de defensa pasan por el uso de sonidos que confundan al modelo, como ruido blanco, filtros de audios basados en software o incluso la reproducción de sonidos de teclas de otros teclados. El uso de teclados más silenciosos como los de membrana no parecen ser una solución totalmente fiable.

El mayor temor que se plantea en torno a este escenario incluye el robo de contraseñas y datos registrando la pulsación de teclas de su víctima, y ya ha quedado claro que su tasa de eficacia es brutalmente alta. Está por ver si esta situación se acaba trasladando a una realidad de Internet que promete estar dominada por la inteligencia artificial.