La fusión entre cuerpo y máquina, lejos de la imagen distópica proyectada por el cine y la ciencia ficción, puede ser la solución para muchas personas que dependen de prótesis o de cierta ayuda para valerse por sí solos. En los últimos años ya se ha conseguido publicar el primer tuit simplemente pensándolo gracias al implante Stentrode y se están creando manos robóticas con más sensibilidad. Sin embargo, sigue siendo un desafío controlar con la mente estas extremidades tecnológicas con la misma precisión y delicadeza que consiguen los músculos, los huesos y el sistema nervioso humano.

Recientemente, se han conocido dos nuevos avances en esta materia. Por un lado, investigadores de Australia y Suecia han conseguido fusionar el tejido del hueso con el implante de titanio de una prótesis biónica, que se controla como una mano real y alivia el dolor que puede persistir tras la amputación. Por otra parte, científicos del Instituto Fraunhofer de Ingeniería Biomédica IBMT en Sulzbach, han adoptado un enfoque diferente para conseguir un control más preciso de la mano artificial. Para ello han recurrido a los ultrasonidos, una tecnología que ya se usa en parches para suministrar medicamentos, pero que en estas nuevas prótesis no requiere de operación u osteointegración como en el proyecto mencionado previamente.

Se estima que a tres millones de personas en todo el mundo tienen un brazo o una mano amputada. Este número sigue creciendo y para ellos se ha impulsado el proyecto SOMA con financiación de la Unión Europea en el que se incluye este nuevo invento. Los investigadores de Fraunhofer ya han hecho pruebas para detectar con ultrasonidos e identificar con inteligencia artificial los movimientos que la mano debe hacer según las órdenes del cerebro. Además, también trabajan en respuestas eléctricas que la mano pueda mandar al cerebro para que haya una comunicación casi idéntica a la natural.

Empleo de ultrasonidos

Las prótesis mioeléctricas suelen funcionar con electrodos colocados sobre la piel, los cuales captan señales eléctricas de las contracciones musculares y permiten controlar la prótesis con esos impulsos. Los investigadores de este proyecto han decidido apostar por los ultrasonidos para crear una conexión más directa entre el cerebro y la extremidad artificial.

Los sensores ultrasónicos envían continuamente pulsos de sonido que se reflejan en el tejido muscular del antebrazo, a diferencia de los impulsos eléctricos. La clave en este punto es el tiempo que tardan esos pulsos en propagarse, como si de un radar biotecnológico se tratara. De esta forma, se calcula la profundidad física a la que se encuentra la hebra muscular contra la que se ha reflejado el ultrasonido.

Esquema de la conexión del proyecto.

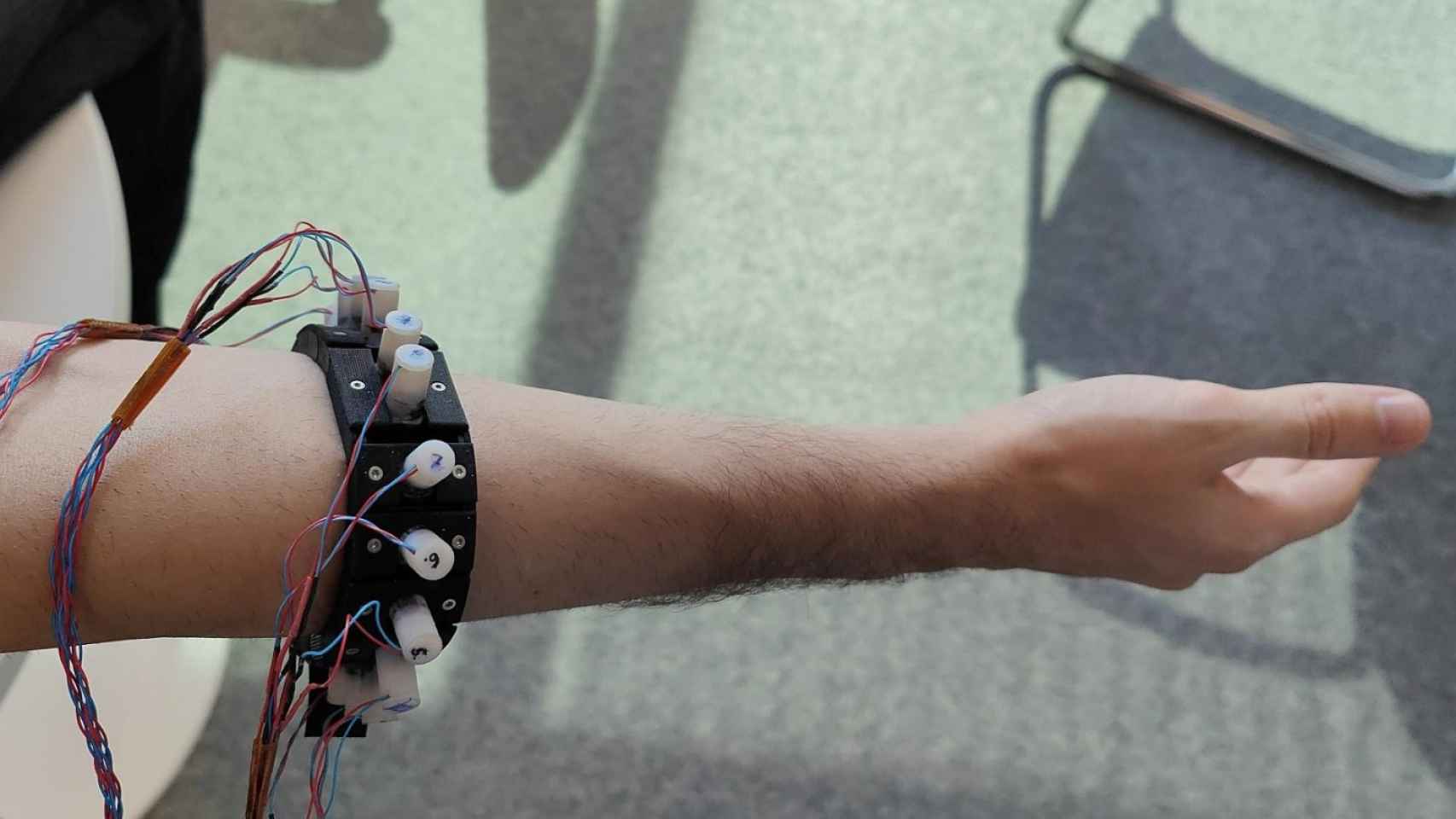

Con esta técnica, los científicos aseguran que pueden saber "con gran detalle las contracciones del tejido muscular provocadas por estímulos nerviosos en el cerebro". Los transductores de sonido piezoeléctricos envían impulsos al tejido muscular decenas de veces por segundo, con una frecuencia de entre 1 y 4 MHz. Además, están interconectados un mínimo de 20 sensores. Estos están integrados en una pulsera que, más adelante, se pretende instalar en la estructura de la prótesis.

Además de la información de profundidad, cada sensor también proporciona datos sobre la posición de la hebra muscular que acaba de enviar una onda. Pero no solo importa cuándo se contrae el músculo, sino también cómo se interpreta cada movimiento para saber qué mensaje está tratando de enviar el cerebro. No es lo mismo empujar una pelota que agarrarla.

[Este "tercer pulgar" es una prótesis innecesaria pero con mucho potencial]

Para identificar ese lenguaje interno del cuerpo está la inteligencia artificial. Esta tecnología, que también se usa en España analizando la salud cardiaca de los pacientes, por ejemplo, se utiliza en este caso concreto para identificar lo que implica para los dedos y la mano esos movimientos musculares. El algoritmo se aloja en una caja electrónica que lleva el paciente instalado en su cuerpo, como un pequeño ordenador.

Una vez reconocida la orden cerebral, este sistema envía las señales descodificadas a los actuadores de la mano protésica, activando los dedos y manos artificiales según sea necesario. Los comandos de control se detectan, analizan y transmiten en tiempo real. "El control ultrasónico actúa con mayor sensibilidad y precisión de lo que sería posible con electrodos. Los sensores pueden detectar distintos grados de libertad, como la flexión, la extensión o la rotación", afirma el Dr. Marc Fournelle, jefe del grupo de Sensores y Actuadores de Fraunhofer IBMT, responsable del desarrollo de los sensores ultrasónicos SOMA dentro del proyecto.

Conexión con el cerebro

En la siguiente etapa del proyecto, los investigadores quieren que el diseño sea bidireccional. De esta manera, el cerebro también recibirá estímulos sensoriales de la prótesis, para poder comprender con qué firmeza se puede agarrar un objeto sin que se escurra o rompa, por ejemplo.

Para ello, el proyecto SOMA está utilizando electrodos implantados en los nervios, al margen de los sensores ultrasónicos mencionados en la primera funcionalidad. La prótesis envía señales al cerebro en forma de estimulación nerviosa específica. El cerebro de la persona reacciona a estos estímulos contestando con la indicación de apretar más o aflojar la mano.

Sensores de ultrasonidos

Los usuarios no pueden sentir el electrodo, que está fabricado de un material biológicamente compatible e implantado en el tejido nervioso, según explican desde el Instituto Fraunhofer de Ingeniería Biomédica IBMT. "Esto significa que se establece un circuito cerrado en el que el cerebro y la prótesis de mano se comunican entre sí constantemente y en tiempo real", dice Fournelle.

Las primeras pruebas

Andreas Schneider-Ickert, director de proyectos de la unidad Active Implants y director de innovación del Fraunhofer IBMT, afirma: "Las pruebas en sujetos han demostrado que la tecnología funciona. Es muy fácil de usar y no invasivo. Ahora estamos trabajando para que el sistema pase aún más desapercibido".

[Esta mano robótica usa tus intenciones para funcionar de forma remota]

El equipo del proyecto SOMA ha estado recopilando comentarios de los sujetos de prueba en cada etapa. Actualmente, trabaja con sujetos que no han sufrido ninguna amputación, para comprobar el funcionamiento de cada elemento.

Los usuarios han tenido que pasar un entrenamiento previo para vincular correctamente las señales recogidas y analizadas por los sensores y la IA con el movimiento final del dedo protésico. Un entrenamiento que dura solo unos minutos y sirve también como referencia base en el sistema para continuar analizando el resto de señales musculares.