En plena campiña del suroeste de Inglaterra, entre los extensos prados y los pintorescos pueblos que forman parte de la comarca de los Cotswolds -a una hora de Bristol- se alzan dos hangares que utilizó la RAF durante la Segunda Guerra Mundial. Desde hace unos años, en su interior se desarrollan los productos e investigaciones más punteras de Dyson, como su abandonado proyecto de coche eléctrico o su arma contra Roomba, el robot aspirador más potente del mercado, que llegará a España el próximo año.

Allí, en el conocido como Hangar 85 del aeródromo de Hullavington, trabajan en torno a 300 personas. En el recorrido que tuvimos la ocasión de hacer en EL ESPAÑOL - Omicrono por este edificio diáfano en el que ingenieros, diseñadores y programadores trabajan mano a mano apuntalando el futuro de la compañía, nos encontramos con Tanis Mar, ingeniero jefe de investigación robótica en Dyson.

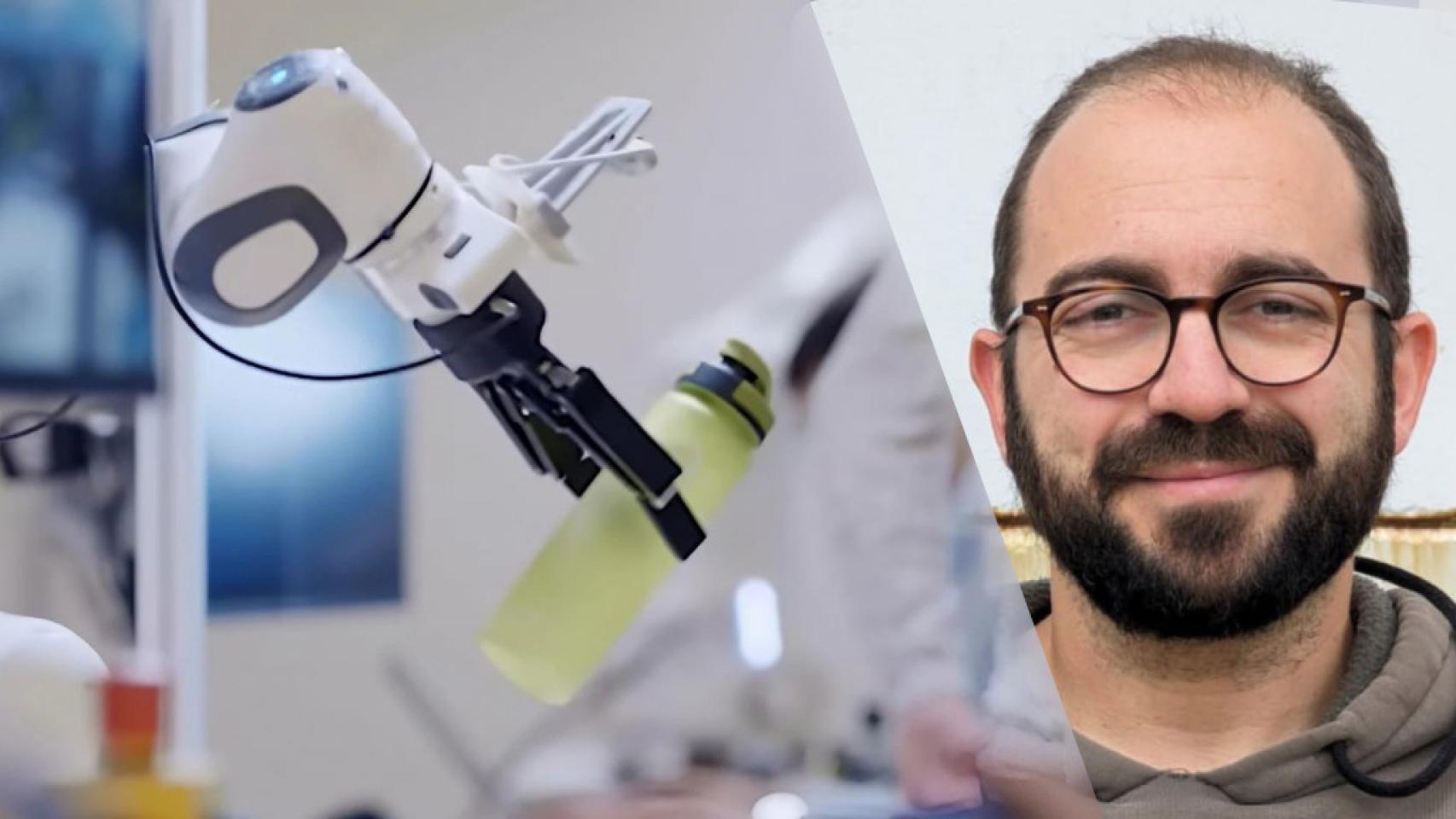

Este zaragozano aficionado a la fotografía y a la ciencia ficción, que se expresa con soltura en cinco idiomas y ha desarrollado su labor investigadora en Alemania, Italia, India y Vietnam, es especialista en la aplicación de la inteligencia artificial a los robots. Su labor en Dyson pasa por idear, programar y dar forma a las próximas generaciones de robots domésticos diseñados para hacer nuestra vida más fácil. Y es que gigantes como Amazon prevén que estas máquinas sean norma en todos los hogares en 5 o diez años.

¿Qué le interesó en primer lugar de una disciplina como la robótica?

El inicio es algo bastante común en mucha gente que hace robótica: haber leído mucha ciencia ficción, novelas y cuentos de Isaac Asimov o Ray Bradbury. También me gusta el anime, cosas como Ghost in the Shell y otras muchas. Son narraciones que plantean preguntas como, ¿si un robot puede ser inteligente, qué somos los humanos? Hay una parte casi filosófica que me interesa mucho del tema.

Lo que me llevó a dedicarme a eso tiene que ver con la última etapa de mi carrera, cuando hice mi proyecto fin de máster, centrado en herramientas de machine learning. Esto era en 2009, cuando la inteligencia artificial todavía no había crecido tanto como ahora. Lo que más me interesaba era desentrañar todos los procesos relacionados con cómo aprendemos. De hecho, después de acabar ingeniería de telecomunicaciones hice un máster sobre neurociencia computacional en Berlín.

Laboratorio de robótica de Dyson

¿Se considera más científico o ingeniero?

Estudiando en Berlín me di cuenta de que igual no estaba hecho para ser científico, es decir, entender cosas, sino para ser ingeniero, es decir, hacer cosas. Durante ese máster, descubrí que hay una escuela de pensamiento que habla de la inteligencia incorporada. Esta corriente propone que la inteligencia no es como una caja a la que le llega información, la procesa y luego hace algo en consecuencia. Lo que propone es que todo sucede a través del cuerpo, que es el que genera y modula la inteligencia, que sirve principalmente para movernos.

Si quería estudiar inteligencia artificial en ese sentido, el siguiente paso tenía que ver con encontrarle un cuerpo. ¿Y qué es un robot sino un cuerpo artificial? En el doctorado profundicé en lo que se llama robótica de desarrollo, que intenta utilizar modelos de aprendizaje, de adultos, de niños y hasta de animales para aplicarlos en robots, con el objetivo de saber si podrían servir para que aprendan mejor y más rápidamente. Y luego me llamaron para trabajar aquí en Dyson. Aunque es menos filosófico y nos centramos en aplicaciones de la robótica, en hacer cosas útiles, eso también tiene sus beneficios y es mucho más interesante en otros sentidos.

La inteligencia no es como una caja a la que le llega información, la procesa y luego hace algo en consecuencia. Todo sucede a través del cuerpo, que es el que genera y modula la inteligencia.

Lo curioso de la robótica es la cantidad de disciplinas que aúna, desde la programación de software hasta cuestiones de física y mecánica...

Yo me dedico sobre todo a la parte del software, lo que hago principalmente es programar en el día a día. Pero desde luego, hay diseño, mecánica, electrónica... Incluso dentro del software tienes varias vertientes. Por un lado está control, o cómo hacer que el robot se mueva donde quieres, pero también está la percepción, la planificación... Muchas veces estoy en el laboratorio moviendo los robots, o sea, que también hay una parte física que es muy interesante.

En Dyson formo parte del grupo de manipulación robótica, es decir, programo robots capaces de agarrar y mover objetos y me dedico a 'enseñarles' cómo manipularlos, como evitar colisiones y ese tipo de cosas. Me dedico sobre todo a la parte de percepción. Los robots tienen sensores que suelen ser cámaras, y lo que ven son un montón de píxeles, que no significan nada inicialmente. Lo que intentamos hacer es convertir esa matriz en información útil que le puede decir al robot "ahí hay una botella" o "ahí hay una mancha", para que pueda actuar en consecuencia.

Los robots aspiradores ya forman parte de nuestra vida cotidiana. ¿Cuál cree que será el siguiente producto robótico que se hará un hueco en nuestras casas?

Es una pregunta que nos hacemos constantemente. Pueden ser mil cosas, algunas que igual son un poco más predecibles, como robots que limpian los sofás u otro tipo de superficies, los robots limpiaventanas, otros que puedan limpiar los baños o que se dediquen a cocinar... No hablo de uno capaz de hacer todas esas cosas, sino de distintos productos con esas capacidades individuales, al menos a corto plazo. Es difícil saber cuál será el siguiente.

Uno de los robots en los que trabaja Tanis Mar

¿Cuánto tiempo se puede tardar en desarrollar uno de estos robots desde cero hasta tener el producto a la venta?

Un prototipo como el brazo robótico que limpia los sofás tardamos más o menos un año y medio en tenerlo listo. Parte de ese proceso tuvo lugar durante la pandemia y los confinamientos, lo que ralentizó mucho las cosas. En su desarrollo participamos únicamente tres personas, pero claro, hay que tener en cuenta que era una especie de prueba de concepto.

Para ello utilizamos un robot industrial que se puede comprar por 15.000 euros, no empezamos de cero. Y el escenario en el que puede actuar es bastante limitado. De ahí a hacer una prueba de concepto con un robot que se pueda mover y limpiar distintas superficies, igual necesitaríamos otro año. Para hacer un producto que cumpla con los estándares de seguridad y que tenga un precio asequible, eso implica muchos más años de investigación. Luego hay que poder producirlo a escala, preparar las fábricas, venderlo... son otros tantos años.

¿Y cuáles son los principales desafíos a la hora de desarrollar este tipo de robots?

Hay un montón de cosas, sobre todo en robots avanzados que puedan ser domésticos, que no están resueltas a nivel tecnológico. No sólo en Dyson, sino a nivel mundial, hay infinidad de cosas que todavía no sabemos cómo resolver. Hablo de elementos de planificación, de estabilidad, de clasificación... Eso ya es un desafío en sí mismo.

Y aunque tuviéramos a mano esas técnicas y métodos, la parte más difícil sería su implementación. Integrarlo en un robot que sea capaz de hacer todo a la vez sin consumir mucha batería, sin necesitar mucha parte de computación, que sea barato y pequeño... Incluso es difícil saber qué quiere o necesita la gente, porque igual estamos desarrollando algo maravilloso pero que al consumidor final le da igual.

La parte más técnica, la que nos afecta directamente, es la infraestructura para trabajar todos juntos. Son muchas líneas de investigación diferentes las que necesitamos que funcionen a la vez en el mismo robot. Conseguir eso a nivel de software es bastante complicado y a veces genera errores: alguien cambia un código aquí y eso rompe algo allá. Que todo funcione a la vez y que sea robusto y seguro es bastante difícil, y eso sólo a nivel de investigación. De ahí a hacer un producto hay un mundo.

La parte más difícil a nivel técnico es la infraestructura para trabajar todos juntos. Son muchas líneas de investigación diferentes las que necesitamos que funcionen a la vez en el mismo robot.

A tenor de los avances que estamos viendo estos últimos años y la eclosión de la inteligencia artificial, la sensación es de vértigo. ¿Cómo lo ve alguien que trabaja directamente en imaginar cómo será el futuro?

A mí me resulta apasionante. Te hace tener que estar muy pendiente, tienes que moverte rápido para seguir aprendiendo. De hecho, en el grupo de trabajo compartimos un montón de papers y vídeos de cosas que la gente va sacando. Siempre hay que estar con un ojo puesto en qué se está desarrollando en el mundo, porque te pueden abrir nuevas posibilidades. Hay cosas que igual hace un año no podíamos hacer, como usar ChatGPT y todos los modelos de IA que están saliendo últimamente, que te pueden ahorrar mucho tiempo con tareas o cuestiones de planificación, que ahora se pueden hacer de manera casi automática.

Hay un ejemplo muy claro, que es la clasificación de imágenes. Hace diez años, cuando empecé, el deep learning daba sus primeros pasos y clasificar cualquier cosa era muy complicado. Las caras igual sí se reconocían bien, pero lo demás no. Y ahora con un móvil haces una foto de cualquier cosa y sabe decirte exactamente qué es. Eso a un robot le viene muy bien, porque puede detectar muchos objetos en la casa y saber por dónde va. El aprendizaje tiene que ser constante, no te puedes dormir en los laureles.

Uno de los robots con los que experimenta el equipo de robótica avanzada de Dyson

Hay un cierto miedo en buena parte de la sociedad a perder el empleo a manos de la inteligencia artificial y los robots. ¿Cómo ve el futuro en ese sentido? ¿Debemos preocuparnos?

Es una pregunta difícil y la respuesta tiene varias partes. Por un lado, la idea de que necesitamos trabajar es casi una falacia del mundo actual. En realidad, lo que necesitamos es gente que nos apoye, recursos para vivir, tiempo y salud. El hecho de tener que trabajar 8 o 10 horas al día es, generalmente, porque no nos queda otra. Yo sí que veo cierto futuro utópico gracias a los robots. Por ejemplo, un país como Noruega, que por sus depósitos de petróleo tiene mejores infraestructuras, educación, servicios sociales, paro... Si pones un robot en un sitio a trabajar suele ser porque genera eficiencias mayores con respecto a tener a un humano, y eso, en cierto sentido, está generando riqueza a nivel global o nacional. Si eso se pudiera extender a una renta básica universal, de manera que no tuviéramos que trabajar, el resultado supondría crear una sociedad mejor.

La responsabilidad está más relacionada con un enfoque político: ¿qué haces con la riqueza que genera un robot? La mayoría de los trabajos que están quitando ahora los robots son aburridos, rutinarios o peligrosos. También hay muchas veces en que nos dan miedo los robots humanoides por una cuestión cultural. Mientras tanto, hay muchísima automatización que está sucediendo ya, como las máquinas cajeras en los supermercados, que han quitado ya muchísimos más empleos que cualquier robot humanoide, o incluso de fábrica, y nadie parece darse mucha cuenta. Pero claro, un robot que tenga ojos y brazos siempre da un poco más de miedo que una máquina que lee códigos de barras y te cobra o te permite hacer el check-in de forma automática.

Hay muchísima automatización que está sucediendo ya, como las máquinas cajeras en los supermercados, que han quitado ya más empleos que cualquier robot humanoide

En cuanto a la inteligencia artificial, la cuestión va un poco más allá, porque los trabajos que está amenazando tienen más que ver con cuestiones creativas, como la ilustración, la fotografía o la escritura...

Siempre nos habían vendido la inteligencia artificial como algo que haría muy bien los cálculos y muy mal la creatividad. Y de repente, ChatGPT y similares pueden crear poemas, canciones, dibujos o lo que sea. Sin embargo, si le pides que haga algún cálculo, falla bastante. Es justo lo contrario de lo que esperábamos todos.

Por ese lado, por supuesto hay mucha disrupción y no sé muy bien qué va a pasar con muchos trabajos. Pero, de nuevo, el trabajo en sí no me parece lo preocupante, lo que hay que plantearse es qué podemos hacer en vez de ese trabajo y cómo utilizar estas IAs como herramientas para desarrollar nuevas capacidades.

Como buen aficionado a la ciencia ficción, ¿cómo ve el mundo dentro de 50 o 100 años, en cuanto a los productos tecnológicos que podríamos usar en nuestro día a día?

Espero que hasta cierto punto, porque si no estaríamos haciendo muy mal nuestro trabajo, haya algún tipo de robot doméstico como los que estamos planteando en nuestro departamento. Los coches autónomos para entonces igual ya sí operan con normalidad, porque están tardando mucho más de lo que deberían.

Esto es una opinión muy personal, pero yo creo, como casi siempre pasa con la humanidad, que ni será una utopía feliz, ni una distopía ciberpunk ultracapitalista, en la que cada uno vaya a lo suyo y la moneda de cambio sea la violencia. Me imagino una cosa intermedia, en la que habrá cosas que mejoren bastante y otras que no tanto. Es una visión optimista, pero algo cínica. Los humanos somos así: va a estar bien, pero tampoco va a ser la hostia.