Fotomontaje de OpenAI El Androide Libre

2025 va a ser el año de los agentes IA: OpenAI anuncia su próxima generación de modelos de audio que les dará voz

Los creadores de ChatGPT siguen anunciando nuevos modelos en su carrera hacia GPT-5 y las propuestas tanto en la GenAI como el razonamiento.

Más información: OpenAI reta a Google: actualiza ChatGPT y ya permite activarlo como el asistente de voz por defecto en tu móvil

2025 va a ser el año de los agentes IA y OpenAI ha estado moviendo sus fichas en estas semanas pasadas para anunciar GPT-4.5 o mismamente ayer su modelo de IA a mayor coste con o1-pro. Hoy OpenAI ha anunciado nuevos modelos de audio de texto a voz y voz a texto en el API que va a abrir las puertas a que los desarrolladores puedan crear agentes IA con voz más expresivos, naturales y más personalizables.

El objetivo es proporcionar un modelo de audio que pueda ser usado por los agentes IA y que los desarrolladores puedan personalizar su voz o acento. Si el modelo de voz avanzado de ChatGPT cuenta con distintas voces, lo que ha hecho OpenAI ahora es proporcionar esa misma experiencia para que cualquier desarrollador pueda crear una voz única.

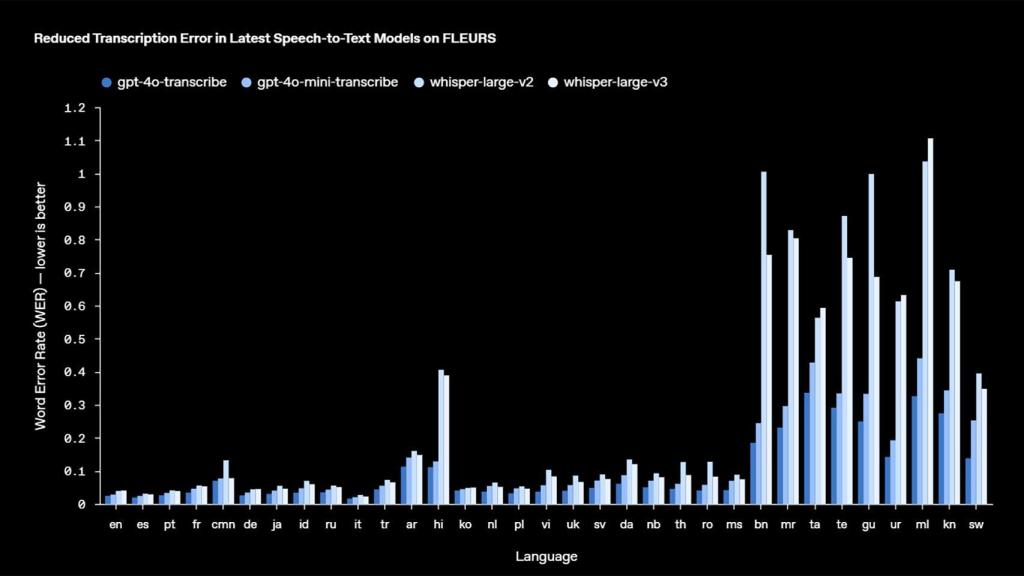

Aquí entran en juego dos modelos, GPT-4o y GPT-4o mini para la transcripción y que destacan por ofrecer un rendimiento importante en este tipo de tareas para minimizar los errores en palabras, reconocimiento del idioma o eficacia comparado con otros de OpenAI.

Para OpenAI no ha sido fácil llegar a este hito, ya que para que los dos modelos formen parte de los nuevos de audio han tenido que ser desarrollados con técnicas de aprendizaje exhaustivo intermedio y con conjuntos de datos de audio diversos y de alta calidad.

Hay varios matices bien importantes en estos nuevos modelos de audio como su capacidad para entender acentos en la voz, reducir los posibles fallos al reconocer la voz y mejoras en la capacidad para la transcripción incluso cuando la entrada de audio incluye entornos ruidosos, acentos especiales y variedad de velocidad en el habla.

El nuevo modelo de audio de OpenAI El Androide Libre

OpenAI también ha anunciado el precio de estos nuevos modelos de audio para IA y el modelo de transcripción GPT-4o tiene un coste de 6 dólares por un millón de tokens de entrada de audio, 2,50 dólares por millón de tokens de entrada de texto y 10 dólares por millón de tokens de salida de texto.

El modelo basado en GPT-4o mini tiene un coste de 3 dólares por millón de tokens de audio de entrada, 1,25 dólares por millón de tokens de entrada de texto y 5 dólares por millón de tokens de entrada de audio. Los costes por minuto de transcripción quedan en 0,6 céntimos de dólar para GPT-4o, 0,3 céntimos para GPT-4o mini y 1,5 céntimos para GPT-40 mini TTS.

El Androide Libre

Para entender mejor qué significan los nuevos modelos de audio de IA de OpenAI recogemos las palabras del mismo equipo desde su anuncio: "De cara al futuro, nuestro objetivo es seguir invirtiendo en mejorar la inteligencia y precisión de nuestros modelos de audio y explorar formas para que los desarrolladores puedan incorporar sus propias voces personalizadas para crear experiencias aún más personalizadas de manera alineada con nuestros estándares de seguridad".